Architecture Data bancaire : Comment moderniser son socle pour l’IA Agentique ?

Table des matières

- Le fardeau du Legacy : Pourquoi l’architecture bancaire classique bloque l’IA

- Les 3 piliers d’une architecture Data bancaire prête pour l’IA Agentique

- Sécurité et Gouvernance : Déployer des agents autonomes de confiance

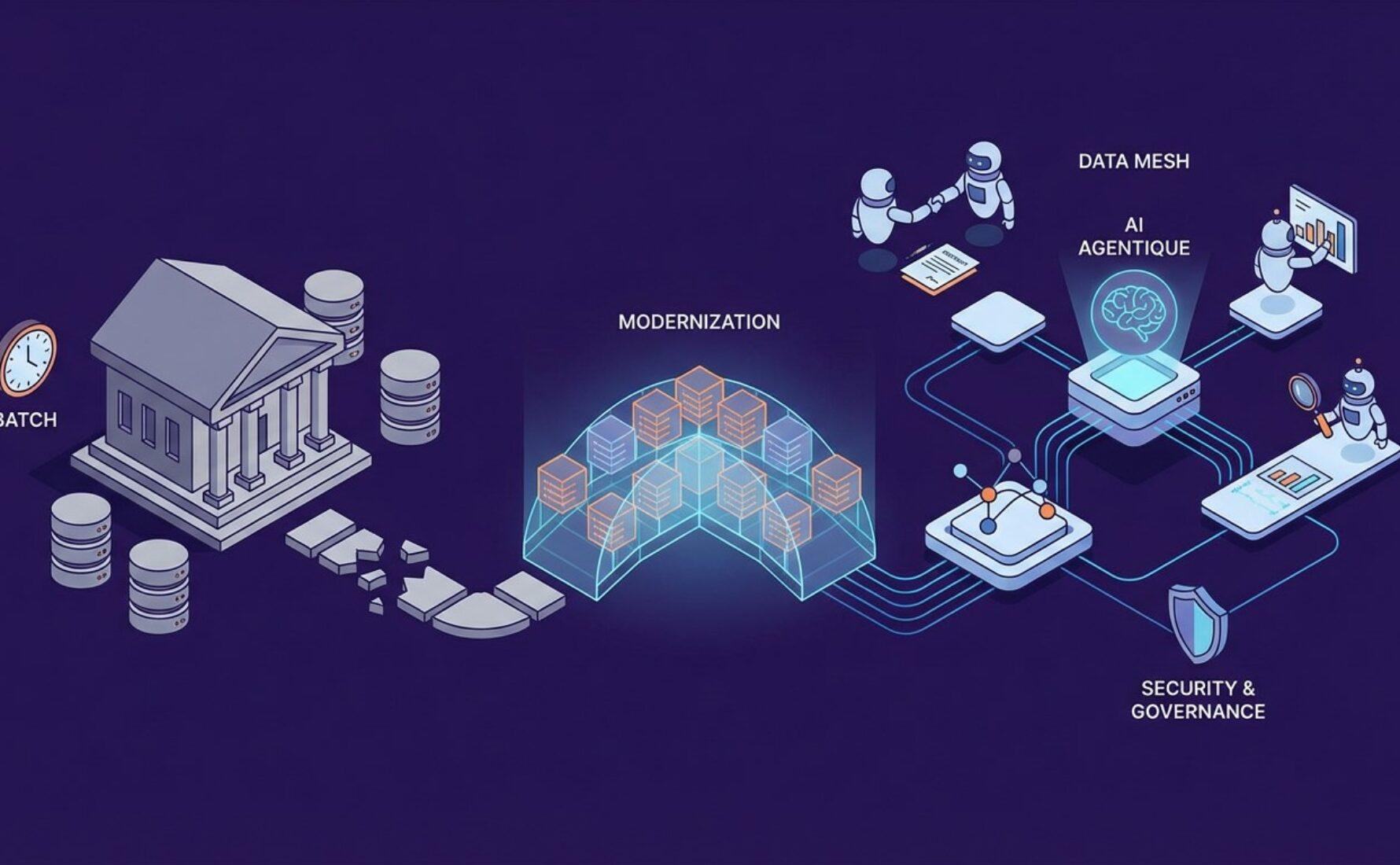

La modernisation de l’architecture data bancaire constitue le chantier prioritaire pour les institutions financières souhaitant basculer dans l’ère de l’IA agentique. Alors que l’intelligence artificielle générative classique se cantonne souvent à la production de contenus ou à l’assistance conversationnelle simple, l’IA agentique ambitionne d’exécuter des processus métier complets de manière autonome. Pour qu’un agent puisse arbitrer un dossier de prêt, détecter une fraude complexe en temps réel ou conseiller un client sur la gestion de son patrimoine, il doit pouvoir naviguer avec agilité dans un écosystème de données historiquement rigide. Ce saut technologique impose de repenser les fondations mêmes du système d’information bancaire pour passer d’un modèle de stockage passif à une plateforme d’action intelligente.

Le secteur bancaire porte un héritage technologique lourd, marqué par des Core Banking Systems (CBS) souvent conçus pour une ère pré-digitale où la donnée était traitée par silos de produits. Cette fragmentation entre les comptes courants, l’épargne, les crédits et les flux de paiement empêche l’IA agentique de bénéficier d’une vision holistique du client, pourtant indispensable à son raisonnement. Le cabinet Converteo souligne que la réussite d’une stratégie d’IA autonome en banque ne dépend plus de la sélection du modèle de langage le plus performant, mais de la capacité de l’architecture data à alimenter ces modèles en données fraîches, structurées et hautement sécurisées. Sans une modernisation profonde du socle, les initiatives d’IA risquent de rester au stade du prototype sans jamais atteindre l’échelle industrielle.

L’adoption d’une architecture orientée « Event-Driven » et le déploiement de paradigmes comme le Data Mesh deviennent des passages obligés pour répondre aux exigences de l’agentivité. Un agent IA n’attend pas la fin d’un cycle de traitement nocturne (mode Batch) pour réagir à un comportement client ; il a besoin de capter les signaux au fil de l’eau pour ajuster ses recommandations ou ses alertes de conformité. Cette réactivité impose de briser les silos monolithiques au profit de domaines de données décentralisés, où chaque direction métier devient responsable de la qualité et de la mise à disposition de ses propres actifs data via des API robustes. Cette approche garantit la scalabilité nécessaire au déploiement de dizaines d’agents spécialisés travaillant de concert au sein de la banque.

L’objectif de cet article est de détailler la feuille de route technique pour moderniser votre architecture data bancaire et la rendre compatible avec l’IA agentique. Nous explorerons les leviers critiques de cette transformation, de l’intégration de bases de données vectorielles pour supporter le Retrieval-Augmented Generation (RAG) financier à l’intégration des contraintes réglementaires comme l’AI Act ou DORA. En analysant les bénéfices opérationnels d’un socle data modernisé, nous démontrerons comment la technologie peut transformer la banque en une plateforme de services autonomes, sécurisée et hyper-personnalisée. La modernisation n’est plus un projet informatique de second plan, mais le moteur de la survie stratégique des banques face à l’émergence des fintechs et de l’IA.

Le fardeau du Legacy : Pourquoi l’architecture bancaire classique bloque l’IA

L’architecture bancaire traditionnelle repose sur des décennies de sédimentation logicielle, créant un environnement où la donnée est souvent prisonnière de formats propriétaires et de systèmes mainframe isolés. Ces silos par produit empêchent l’émergence d’une intelligence agentique capable de croiser les informations de manière transversale. Si un agent IA doit analyser le risque de défaut d’un client, il ne peut se contenter des données de son compte de dépôt ; il doit accéder instantanément à son historique de crédit, ses actifs financiers et même ses interactions récentes avec le service client. Or, dans beaucoup d’institutions, la synchronisation de ces données prend encore plusieurs heures, voire plusieurs jours, ce qui rend toute velléité d’autonomie décisionnelle en temps réel totalement caduque.

Le mode de traitement « Batch », pilier historique du SI bancaire, constitue le second frein majeur à l’IA agentique. Les processus de fin de journée, hérités des contraintes de calcul du siècle dernier, ne sont plus compatibles avec une IA qui doit réagir à la milliseconde pour bloquer une transaction frauduleuse ou proposer une offre contextuelle lors d’un paiement. L’agentivité demande une architecture fluide où la donnée circule en continu. Le passage d’un modèle monolithique à une architecture distribuée, basée sur des microservices et des bus d’événements, est donc la première étape indispensable pour donner à l’IA la vélocité nécessaire. Cette transformation permet de passer d’une banque réactive, qui constate les événements a posteriori, à une banque proactive pilotée par des agents autonomes.

Les 3 piliers d’une architecture Data bancaire prête pour l’IA Agentique

Le premier pilier de cette modernisation est l’adoption du Data Mesh, qui déplace la responsabilité de la donnée vers les domaines métiers. Dans une banque, cela signifie que les équipes Crédit, Risque ou Marketing produisent et gèrent leurs données comme des produits autonomes, accessibles via des interfaces standardisées. Pour l’IA agentique, cette organisation est une bénédiction car elle permet de découvrir et de consommer des sources de données certifiées sans passer par une équipe data centrale souvent surchargée. Le Data Mesh offre la souplesse nécessaire pour entraîner et déployer des agents experts dans chaque domaine, tout en garantissant une interopérabilité totale grâce à une gouvernance fédérée qui définit les règles de partage et de sécurité à l’échelle de toute l’entreprise.

Le second pilier réside dans le passage à une architecture Event-Driven, utilisant des technologies comme Kafka pour orchestrer les flux de données en temps réel. Cette approche permet de transformer chaque action client en un événement diffusable à l’ensemble du système. Un agent IA peut ainsi s’abonner au flux des transactions par carte pour détecter des motifs de dépenses inhabituels et déclencher immédiatement un conseil budgétaire ou une vérification d’identité. Cette réactivité change radicalement la perception du service bancaire, qui devient un compagnon quotidien intelligent plutôt qu’un simple gestionnaire de comptes. L’architecture Event-Driven est le système nerveux central indispensable à la coordination des agents autonomes au sein de workflows complexes.

Le troisième pilier est l’intégration de bases de données vectorielles pour supporter le Retrieval-Augmented Generation (RAG) appliqué à la finance. Les banques disposent d’une masse colossale de données non structurées, comme des rapports d’analyse, des contrats de prêt ou des transcriptions d’appels. Les bases de données vectorielles permettent de transformer ces informations en vecteurs mathématiques exploitables par les agents IA pour retrouver des contextes précis en un instant. Cette technologie permet à l’agent de fonder ses décisions sur la documentation réglementaire la plus récente ou sur les clauses spécifiques du contrat d’un client, réduisant ainsi drastiquement les risques d’hallucinations. C’est l’alliance de la donnée structurée transactionnelle et de la donnée non structurée contextuelle qui donne à l’IA bancaire sa véritable puissance d’action.

Sécurité et Gouvernance : Déployer des agents autonomes de confiance

Dans le secteur bancaire, l’innovation ne peut se faire au détriment de la sécurité et de la confidentialité des données. Le déploiement d’agents autonomes impose une maîtrise totale de la souveraineté des données pour éviter toute fuite (Data Leakage) vers des modèles d’IA publics. La modernisation de l’architecture doit donc inclure des environnements de Cloud souverain ou des instances d’IA privées où les données sensibles restent confinées. La mise en place de barrières d’accès strictes (Data Guardrails) garantit que l’agent n’accède qu’aux informations strictement nécessaires à sa mission, conformément au principe du moindre privilège. Cette sécurisation by design est le socle de la confiance indispensable pour confier des tâches critiques, comme le KYC (Know Your Customer), à des agents autonomes.

Enfin, l’observabilité et la traçabilité des décisions prises par les agents sont des impératifs réglementaires majeurs, notamment avec l’entrée en vigueur de l’AI Act européen et de la directive DORA. Chaque action d’un agent IA doit être logguée, auditable et explicable par les autorités de contrôle. L’architecture data doit donc intégrer des outils de lignage (lineage) capables de remonter jusqu’à la donnée source qui a justifié une décision automatisée. Cette transparence n’est pas seulement une contrainte légale ; c’est aussi un outil d’amélioration continue qui permet d’identifier les dérives algorithmiques et de réajuster les prompts ou les modèles en fonction des feedbacks opérationnels. En automatisant la conformité au sein même de l’architecture, la banque sécurise sa transformation tout en libérant son potentiel d’innovation.

En conclusion, la modernisation de l’architecture data bancaire est l’étape critique qui sépare les banques qui subissent l’IA de celles qui l’utilisent comme un levier de croissance. L’agentivité demande un socle agile, réactif et décentralisé, capable de fournir une donnée de haute qualité en temps réel. En investissant dans le Data Mesh, l’Event-Driven et des technologies de RAG sécurisées, les institutions financières se donnent les moyens de déployer des services autonomes à forte valeur ajoutée. Le futur de la banque ne se jouera pas uniquement sur ses produits financiers, mais sur sa capacité à orchestrer une intelligence collective d’agents IA au service de ses clients et de sa performance opérationnelle.