Maintenance prédictive industrielle : Le triomphe des Small Models spécialisés

Dans un univers industriel où chaque seconde d’arrêt compte, la tentation de s’en remettre aux intelligences artificielles omniscientes est grande. Pourtant, derrière la promesse d’une automatisation totale, le mirage des IA génératives géantes se dissipe rapidement lorsqu’il est confronté aux exigences implacables du terrain. Les usines modernes, rythmées par le bourdonnement incessant des machines et le flux continu des pièces, nécessitent des solutions technologiques capables de réagir dans l’instant, sans la moindre marge d’erreur. C’est dans ce contexte d’exigence absolue que les paradigmes technologiques doivent évoluer pour répondre aux véritables enjeux de la chaîne de production.

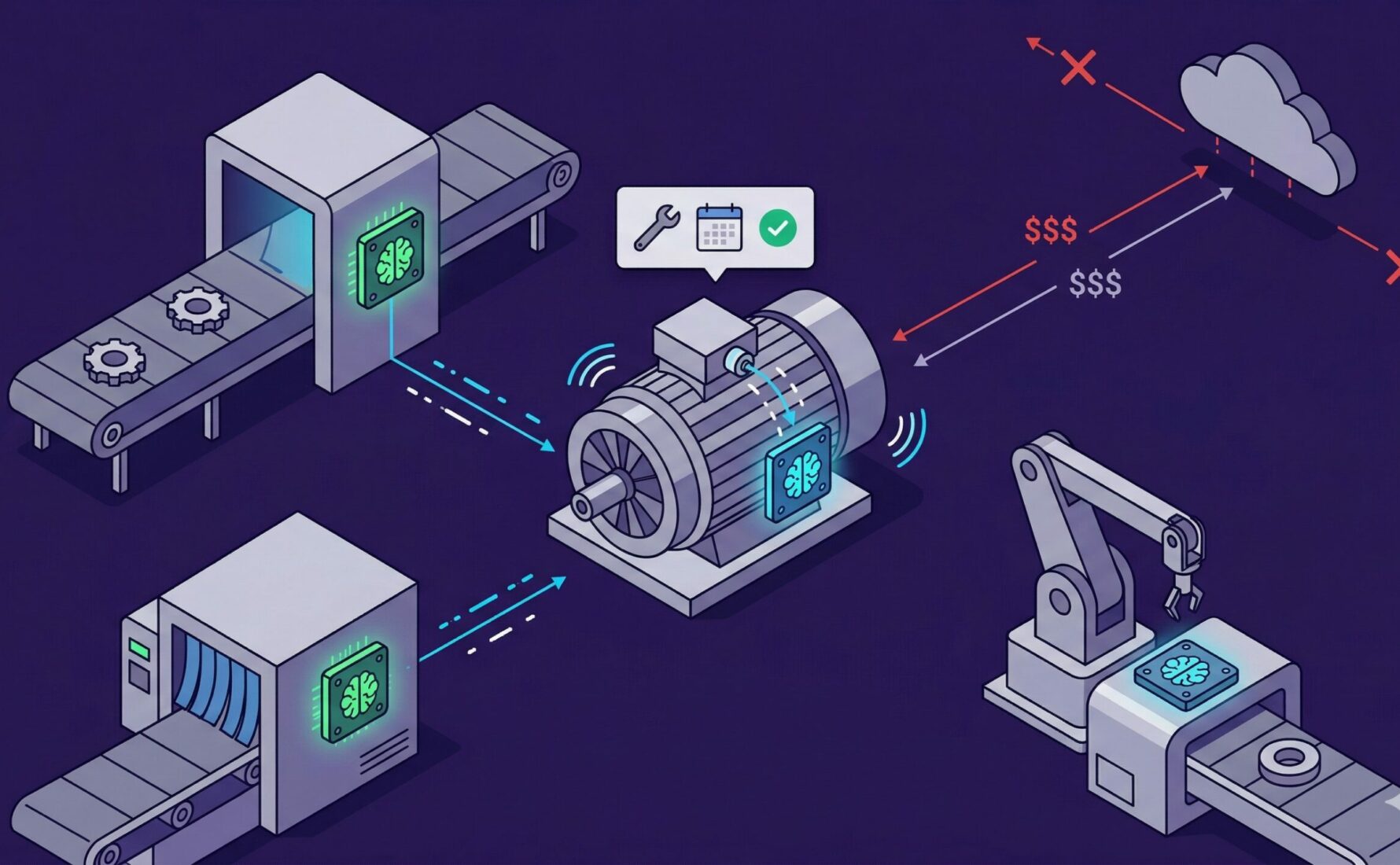

Les contraintes inhérentes à la maintenance industrielle rendent en effet l’utilisation des mégamodèles classiques particulièrement hasardeuse et financièrement lourde. Le traitement des données en temps réel se heurte souvent aux limites de latence imposées par les architectures cloud traditionnelles, tandis que la confidentialité des processus de fabrication industriels interdit l’envoi d’informations sensibles vers des serveurs externes. À cela s’ajoute le coût exorbitant lié à l’hébergement et à la puissance de calcul requise pour faire tourner des algorithmes généralistes qui, paradoxalement, manquent cruellement de précision face à des anomalies mécaniques spécifiques. L’industrie a besoin de pragmatisme opérationnel, pas de discours conceptuels déconnectés de la réalité du terrain.

Face à cette impasse technologique et opérationnelle, une nouvelle approche s’impose de plus en plus comme le standard incontournable de l’usine connectée : le triomphe des modèles de taille réduite, plus communément appelés Small Models. Contrairement à leurs homologues généralistes, ces algorithmes frugaux sont conçus et entraînés sur mesure pour accomplir une tâche unique avec un degré de précision chirurgicale. En se concentrant exclusivement sur les données émises par l’équipement qu’ils surveillent, ces modèles ultra-spécialisés réussissent le tour de force de concilier une empreinte carbone minimale, une exécution immédiate directement sur la machine, et une fiabilité sans faille dans la détection des défaillances.

L’adoption de cette technologie transforme radicalement l’approche de la performance industrielle en passant d’une maintenance réactive subie à une anticipation millimétrée des pannes. Pour comprendre cette révolution silencieuse, il est essentiel d’explorer en profondeur les avantages techniques de ces algorithmes spécialisés, d’analyser leurs cas d’usage concrets sur les chaînes d’assemblage, et de définir les étapes indispensables à leur déploiement réussi. L’objectif est de démontrer comment la maîtrise de la donnée industrielle locale permet de maximiser la rentabilité des équipements tout en sécurisant la continuité absolue de la production.

Les limites des mégamodèles d’IA dans l’environnement industriel

Le défi de la confidentialité et de la latence (Edge Computing)

L’environnement industriel se caractérise par une génération massive de données critiques qui requièrent un traitement immédiat, rendant obsolètes les allers-retours constants vers des serveurs distants. Lorsqu’une turbine ou un moteur industriel présente les premiers signes de défaillance, la décision d’interrompre ou d’ajuster la cadence de production doit être prise en l’espace de quelques millisecondes. C’est précisément ici que les architectures décentralisées et le Edge Computing prennent tout leur sens. Contrairement aux approches basées sur le cloud qui introduisent une latence incompressible, le traitement local garantit une réactivité instantanée tout en préservant le secret industriel. Les usines manipulent des recettes de fabrication, des cadences stratégiques et des processus uniques qui ne peuvent en aucun cas être exposés sur des réseaux publics, rendant les solutions d’intelligence artificielle hébergées totalement incompatibles avec les normes de sécurité les plus strictes du secteur manufacturier.

La nécessité d’une précision absolue face aux hallucinations

Les grands modèles de langage et les intelligences artificielles génératives ont une fâcheuse tendance à produire des résultats erronés ou extrapolés, un phénomène totalement inacceptable lorsque la sécurité des opérateurs et l’intégrité de la chaîne de production sont en jeu. Dans le domaine manufacturier, une alarme manquée ou une fausse alerte déclenchant un arrêt inutile entraîne des répercussions financières catastrophiques. Une étude récente démontre que le coût d’une seule minute d’arrêt de production imprévu s’élève en moyenne à dix mille euros dans le secteur automobile, illustrant la pression financière qui pèse sur les équipes de maintenance. Les mégamodèles, conçus pour la polyvalence linguistique ou visuelle, n’ont ni la rigueur mathématique ni la spécialisation requise pour interpréter avec justesse les subtilités d’un signal vibratoire complexe. L’industrie ne tolère aucune approximation ; elle exige un déterminisme absolu que seuls des algorithmes étroitement calibrés pour une mission spécifique peuvent lui fournir.

Pourquoi les « Small Models » sont la clé de la maintenance prédictive

Frugalité énergétique et rapidité d’entraînement sur la « Small Data »

L’efficacité redoutable des modèles spécialisés repose paradoxalement sur la limitation volontaire de leur périmètre d’apprentissage, privilégiant l’hyper-pertinence à l’exhaustivité. Comme le rappellent souvent les experts en intelligence artificielle, la qualité de la donnée et l’entraînement des modèles de Machine Learning supplantent systématiquement la quantité brute d’informations avalées par un algorithme. Dans le cadre de la maintenance prédictive industrielle, on parle de « Small Data » : des historiques de températures, des enregistrements de pressions hydrauliques ou des fréquences de rotation hautement qualifiés. L’entraînement d’un modèle frugal sur ces données extrêmement ciblées ne nécessite qu’une fraction de la puissance de calcul habituelle, permettant un déploiement rapide et des mises à jour itératives sans faire exploser la facture énergétique. Cette approche agile permet de créer un jumeau numérique comportemental parfait pour chaque machine, rendant l’algorithme capable de détecter la moindre déviation par rapport à la norme de fonctionnement optimale.

Intégration facilitée aux architectures IoT et systèmes existants

Le succès opérationnel d’un projet d’intelligence artificielle réside dans sa capacité à s’insérer harmonieusement dans un écosystème technologique souvent vieillissant et hétéroclite. Les usines exploitent généralement des automates programmables industriels et des réseaux de capteurs mis en place il y a plusieurs décennies. Les Small Models, grâce à leur légèreté informatique impressionnante, peuvent être embarqués directement dans les microcontrôleurs des capteurs IoT existants, transformant instantanément un composant passif en un instrument de mesure intelligent. En mesurant les vibrations d’un compresseur ou les variations thermiques d’une pompe, le modèle analyse la donnée à la source et ne transmet au système central que les alertes qualifiées. Cette architecture allégée évite l’engorgement des réseaux de l’usine et simplifie grandement la standardisation des données comme un véritable produit interne exploitable par l’ensemble des départements de maintenance et de production.

Cas d’usage concrets et ROI des modèles spécialisés en usine

Détection d’anomalies vibratoires et acoustiques sur ligne de production

L’application la plus probante de cette technologie sur mesure se trouve dans l’analyse vibratoire et acoustique des équipements rotatifs lourds. Prenons l’exemple concret d’un fabricant de pièces aéronautiques utilisant des fraiseuses à commande numérique de très haute précision. En déployant un algorithme spécialisé directement sur la broche de la machine, l’industriel devient capable d’analyser le spectre sonore généré par la découpe du métal en temps réel. Le modèle, préalablement entraîné sur l’empreinte acoustique d’un roulement sain, identifie instantanément les micro-frictions annonciatrices d’une usure prématurée de l’outil, bien avant que la dégradation ne devienne perceptible par l’oreille humaine ou n’impacte la qualité de la pièce usinée. L’opérateur reçoit alors une notification précise l’invitant à planifier une intervention lors du prochain changement d’équipe, évitant ainsi un arrêt brutal de la ligne en pleine journée de production.

Optimisation de la durée de vie des pièces critiques

Au-delà de la simple prévention des pannes dramatiques, l’intelligence artificielle frugale offre un levier financier majeur en optimisant le cycle de vie réel des composants industriels. Traditionnellement, la maintenance préventive se base sur des calendriers d’intervention stricts et théoriques, poussant les usines à remplacer des pièces encore parfaitement fonctionnelles uniquement parce qu’elles ont atteint une certaine durée de vie calendaire. Le passage à une maintenance véritablement prédictive permet de consommer la totalité du potentiel d’usage d’un composant en toute sécurité. Des retours d’expérience dans l’industrie métallurgique montrent que l’utilisation de modèles prédictifs sur mesure permet de prolonger la durée d’exploitation des pièces d’usure de près de trente pour cent, tout en réduisant les coûts globaux de maintenance de vingt-cinq pour cent. Ce retour sur investissement rapide justifie pleinement la démarche d’hyper-spécialisation algorithmique.

Comment réussir le déploiement de son modèle prédictif sur mesure ?

De la collecte des données à l’industrialisation MLOps

La réussite d’un tel projet technologique nécessite une méthodologie rigoureuse qui dépasse le simple cadre expérimental de la Data Science pour entrer dans le domaine de l’ingénierie logicielle robuste. De nombreux industriels se demandent quels sont les prérequis pour se lancer dans cette aventure technologique. La première étape cruciale consiste à auditer l’infrastructure existante pour s’assurer que les capteurs en place collectent des données de qualité, pertinentes et correctement historisées. Une fois le modèle frugal conçu et entraîné avec succès sur un équipement pilote, le véritable défi réside dans son déploiement à l’échelle de toute l’usine. C’est ici qu’intervient l’industrialisation MLOps, une discipline essentielle qui permet d’automatiser le monitoring continu des performances de l’algorithme, de gérer les dérives comportementales au fil des mois et de redéployer des versions mises à jour sans interrompre les opérations industrielles courantes.

La voie vers une industrie intelligente et pragmatique

Le secteur industriel vit actuellement une transition technologique majeure, tournant définitivement le dos aux promesses souvent excessives des intelligences artificielles généralistes pour embrasser le pragmatisme redoutable des algorithmes de petite taille. La maintenance prédictive industrielle prouve aujourd’hui qu’une approche hyperspécialisée, frugale et déployée au plus près des machines constitue la seule réponse viable aux impératifs de rentabilité, de sécurité et de continuité d’exploitation des usines modernes. En réduisant drastiquement les temps d’arrêt non planifiés et en prolongeant la durée de vie des actifs critiques, ces modèles sur mesure s’imposent comme le véritable moteur de l’industrie 4.0.

Cependant, la bascule vers cette maintenance de précision nécessite une véritable expertise pour qualifier la donnée brute et orchestrer le déploiement technique sur des chaînes de production complexes. Pour transformer vos historiques de machines en véritables leviers de performance opérationnelle et garantir le retour sur investissement de vos projets, les experts Data et Intelligence Artificielle de Converteo vous accompagnent dans l’audit complet de vos installations industrielles.