Consentement et Data Tracking : Les prérequis légaux de l’IA Agentique pour les Médias

Table des matières

- Le nouveau paradigme du consentement à l’ère des agents autonomes

- Data Tracking et Web Scraping : Protéger son patrimoine informationnel

- Stratégies de gouvernance : Réconcilier innovation et Privacy

Le déploiement des agents autonomes et de l’IA agentique redéfinit radicalement les interactions entre les utilisateurs et les interfaces numériques des groupes de presse. Cette évolution technologique ne se contente pas de modifier l’expérience de consommation de l’information, elle bouleverse les fondements mêmes de la collecte de données et de la gestion du consentement. Pour les acteurs des médias, le défi consiste désormais à orchestrer une transition fluide entre le modèle classique du tracking publicitaire et celui, beaucoup plus complexe, de l’interaction pilotée par l’intelligence artificielle.

La montée en puissance de ces outils d’IA capable d’exécuter des tâches pour le compte de l’utilisateur impose une réflexion immédiate sur la validité juridique de la donnée collectée. Le cadre légal actuel, principalement articulé autour du RGPD, doit désormais s’adapter à des agents qui ne se contentent plus de lire du contenu, mais qui le synthétisent, le transforment et l’exploitent sans nécessairement passer par les tunnels de conversion traditionnels. Ce changement de paradigme oblige les directions data et juridiques à collaborer étroitement pour préserver la valeur de leur patrimoine informationnel tout en restant conformes aux exigences de transparence.

L’enjeu pour le secteur des médias est d’autant plus critique que les revenus dépendent historiquement de la mesure précise de l’audience et de la qualification des profils. Or, l’IA agentique agit souvent comme un filtre qui peut rendre invisible une partie de la donnée comportementale si elle n’est pas correctement encadrée par des protocoles de tracking spécifiques. La pérennité des modèles économiques repose donc sur la capacité des éditeurs à poser des jalons techniques et légaux robustes avant que ces pratiques ne deviennent la norme du marché.

Dans ce contexte, cet article explore les prérequis essentiels pour naviguer dans l’écosystème de l’IA agentique, de la redéfinition du consentement à la mise en place de stratégies de gouvernance de données proactives. Nous analyserons comment les éditeurs peuvent transformer cette contrainte réglementaire en un avantage concurrentiel durable, en misant sur une transparence accrue et une architecture technique résiliente face aux nouvelles méthodes de moissonnage automatisé.

Le nouveau paradigme du consentement à l’ère des agents autonomes

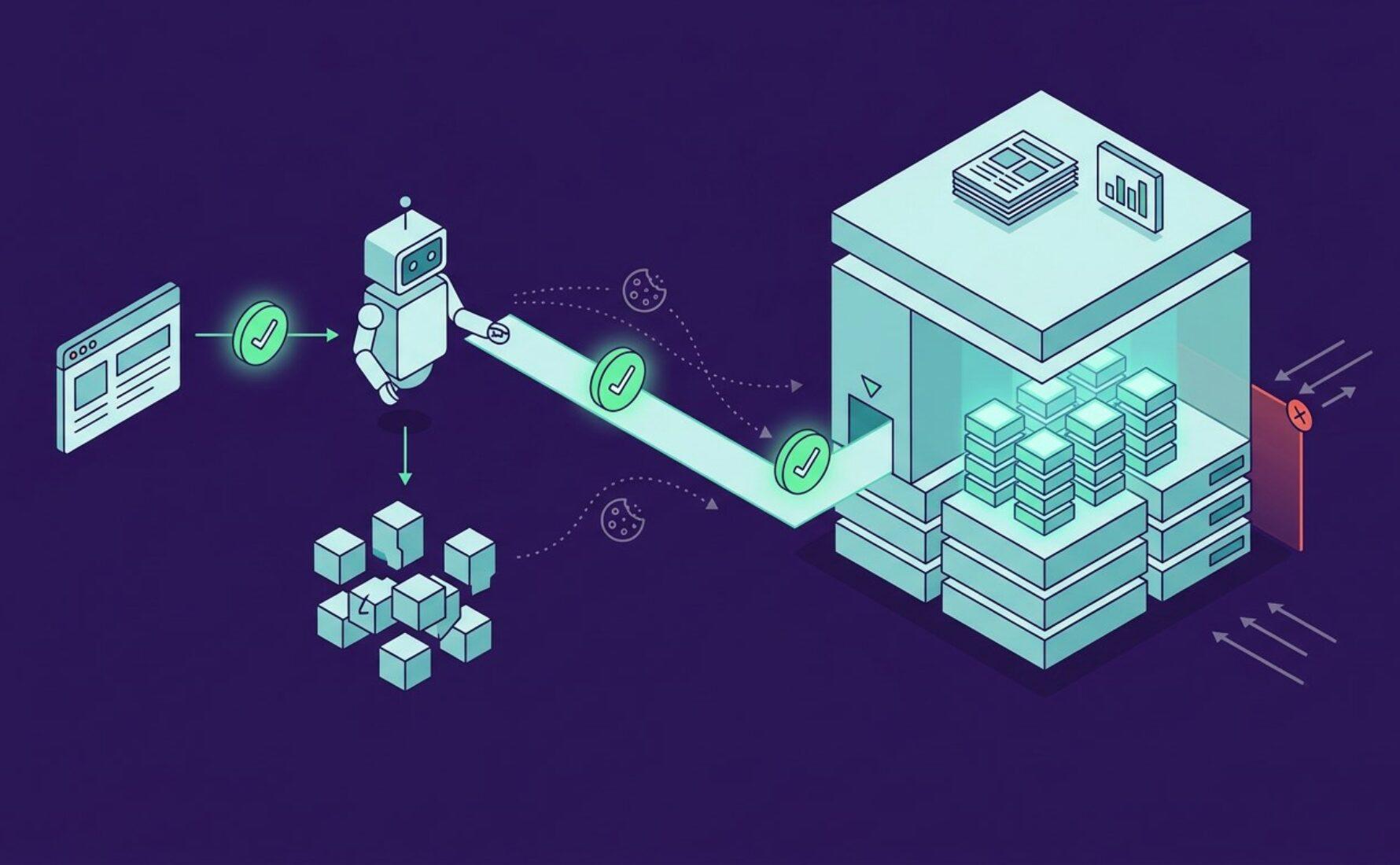

Le passage d’une navigation web traditionnelle à une interaction via des agents autonomes fragilise le mécanisme du bandeau de consentement classique. Jusqu’à présent, le consentement était sollicité lors de l’arrivée de l’utilisateur sur une page web pour autoriser le dépôt de traceurs. Avec l’IA agentique, l’agent agit comme un intermédiaire qui peut potentiellement contourner ces interfaces. Le défi majeur réside dans la transmission du signal de consentement de l’utilisateur final vers l’éditeur à travers l’agent. Si un utilisateur demande à son assistant personnel de résumer l’actualité financière du jour, l’éditeur doit pouvoir s’assurer que les préférences de confidentialité de l’individu sont respectées et que l’utilisation de la donnée par l’IA reste dans les clous de la base légale définie, qu’il s’agisse de l’intérêt légitime ou du consentement explicite.

La gestion des droits d’entraînement devient la nouvelle frontière de la protection des données pour les médias. Contrairement au tracking publicitaire qui visait à recibler un individu, le moissonnage par les agents IA vise à enrichir des modèles de langage. Les éditeurs doivent donc implémenter des mécanismes de consentement granulaire qui distinguent l’affichage publicitaire de l’exploitation sémantique. Les chiffres récents du marché montrent que plus de 40% des éditeurs de presse internationaux ont déjà commencé à bloquer certains crawlers d’IA pour protéger leurs droits d’auteur, illustrant une volonté de reprendre le contrôle sur la destination finale de leurs contenus et des données associées.

L’IA Act, le nouveau règlement européen sur l’intelligence artificielle, vient renforcer ces obligations de transparence. Pour les médias, cela signifie que toute interaction avec un système d’IA doit être clairement identifiée. La conformité ne se limite plus à la simple information sur les cookies, mais s’étend à la nature même de l’interlocuteur. Un agent autonome doit être capable de « déclarer » son identité technique et de respecter les politiques de confidentialité édictées par l’éditeur. Cette transparence est indispensable pour maintenir la confiance de l’utilisateur, qui doit savoir si ses données de lecture servent à affiner ses recommandations personnelles ou à entraîner un modèle global de manière irréversible.

Data Tracking et Web Scraping : Protéger son patrimoine informationnel

Le web scraping, autrefois pratiqué pour le référencement ou l’analyse de prix, change d’échelle avec l’IA agentique. Ces agents utilisent des techniques de moissonnage de données beaucoup plus sophistiquées pour alimenter leurs bases de connaissances en temps réel. Pour un cabinet de conseil comme Converteo, l’analyse des logs montre une augmentation significative de la charge serveur liée à ces requêtes automatisées, qui ne génèrent souvent aucune visite réelle au sens publicitaire du terme. La protection du patrimoine informationnel devient une priorité absolue. Les éditeurs doivent mettre en place des solutions de filtrage intelligentes capables de distinguer les crawlers bénéfiques des agents prédateurs qui siphonnent la valeur ajoutée éditoriale sans contrepartie économique.

Les limites légales du moissonnage de données sont de plus en plus débattues devant les tribunaux internationaux. En Europe, la directive sur le droit d’auteur dans le marché unique numérique offre des leviers, notamment via l’article 4 sur la fouille de textes et de données. Les éditeurs ont le droit d’opposer un « opt-out » explicite à l’entraînement de modèles d’IA. Cependant, la mise en œuvre technique de ce droit reste complexe. Il ne suffit plus de mettre à jour son fichier robots.txt ; il faut désormais intégrer des métadonnées spécifiques et des en-têtes HTTP que les agents d’IA sont tenus de respecter pour être considérés comme conformes. La difficulté réside dans le fait que de nombreux agents ignorent encore ces signaux, rendant la protection juridique parfois symbolique sans défense technique active.

La standardisation de l’opt-out passe par des initiatives comme le Global Privacy Control (GPC), un signal transmis par le navigateur ou l’agent exprimant les préférences de l’utilisateur en matière de vente ou de partage de données. Pour les médias, adopter ces standards est une étape cruciale pour automatiser la gestion du consentement à grande échelle. En intégrant ces signaux dans leur architecture data, les éditeurs peuvent s’assurer que le tracking reste respectueux de la vie privée tout en permettant une personnalisation de l’expérience. Cela demande une mise à jour profonde des plateformes de gestion du consentement (CMP) pour qu’elles deviennent capables de communiquer avec des entités non humaines, créant ainsi un pont entre les attentes juridiques et les réalités techniques du scraping moderne.

Stratégies de gouvernance : Réconcilier innovation et Privacy

La gouvernance des données ne doit plus être perçue comme une contrainte administrative, mais comme un levier stratégique de confiance. Pour un groupe de médias, garantir que les données collectées via des interactions agentiques sont stockées et traitées avec le plus haut niveau de sécurité est un argument marketing de poids. Dans un écosystème saturé d’IA aux origines parfois floues, les marques médias qui affichent une éthique claire sur l’usage de la data se démarquent. Cela implique la mise en place d’une traçabilité totale des flux de données en respectant les principes de la « Privacy by Design ».

Une architecture data « IA-ready » repose sur la capacité à isoler les données sensibles tout en permettant une exploitation agile des informations non nominatives. Les cas d’usage récents chez nos clients montrent que le passage au tracking server-side est une solution efficace pour reprendre la main sur la donnée. En centralisant la collecte sur ses propres serveurs avant de la redistribuer aux partenaires ou aux agents, l’éditeur agit comme un garde-fou. Il peut filtrer les informations avant qu’elles ne quittent son écosystème, garantissant que seul le strict nécessaire est transmis à l’IA agentique, minimisant ainsi les risques de fuite de données personnelles ou de violation du RGPD.

Enfin, la conclusion de cette transition vers l’IA agentique réside dans l’anticipation. Les éditeurs ne peuvent plus se contenter d’être réactifs face aux évolutions des géants de la technologie. Ils doivent activement participer à la définition des nouveaux standards du marché et auditer régulièrement leurs pratiques de conformité. L’IA agentique offre des opportunités de personnalisation sans précédent, mais son succès durable dépendra de la rigueur avec laquelle le consentement et le tracking seront gérés. Pour sécuriser votre stratégie et garantir la conformité de vos actifs numériques, la réalisation d’un audit de maturité data et privacy est aujourd’hui une étape indispensable pour tout acteur média souhaitant pérenniser son modèle économique à l’ère de l’intelligence artificielle.