First-Party Data Médias : Le carburant essentiel pour entraîner vos Small Models

Table des matières

- Du LLM au SLM : Le basculement vers une IA de précision

- La First-Party Data : Le seul actif capable de différencier votre IA

- Stratégies d’entraînement : Le rôle central du Fine-Tuning et du RAG

- Cas pratiques : Quand l’IA média transforme le business

- Conclusion

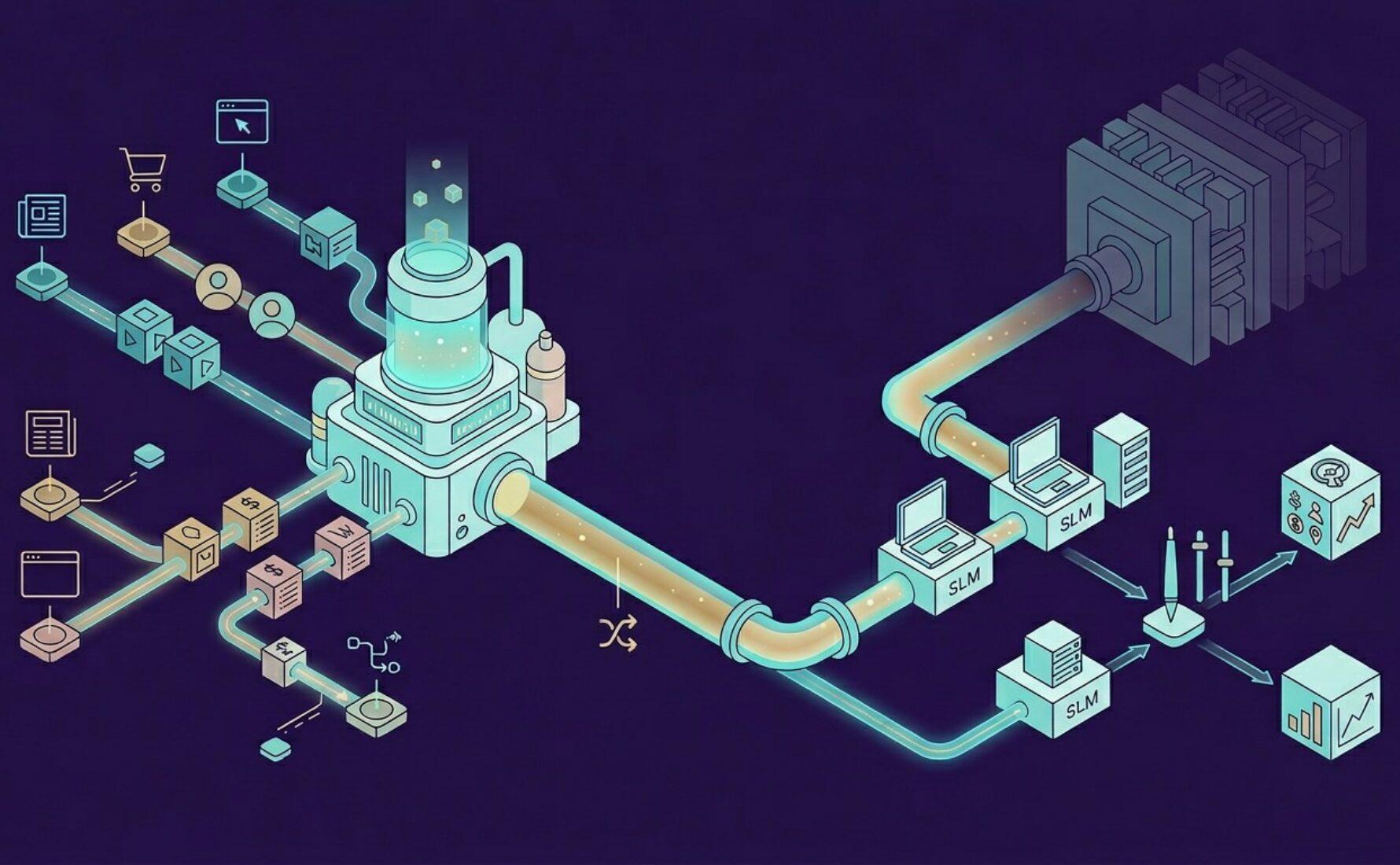

L’industrie de l’intelligence artificielle vit une mutation profonde, passant d’une fascination pour le gigantisme des Large Language Models à une quête de précision chirurgicale. Dans cette course à la performance, les entreprises réalisent que la puissance brute ne remplace jamais la pertinence métier. Pour un cabinet comme Converteo, l’enjeu n’est plus seulement d’accumuler de la donnée, mais de raffiner ses actifs propriétaires pour alimenter des architectures plus agiles.

Cette transition marque l’avènement des Small Models, des structures plus légères et plus sobres, dont la valeur dépend entièrement de la qualité de leur apprentissage. Contrairement aux modèles généralistes nourris au web public, ces modèles spécialisés exigent un carburant spécifique et hautement qualitatif. C’est ici que la donnée média de première main, ou First-Party Data, intervient comme le levier de différenciation majeur pour les marques.

Pourtant, exploiter ce potentiel demande une rigueur méthodologique sans faille pour transformer des signaux bruts en actifs stratégiques exploitables par l’IA. L’objectif est clair : passer d’une approche de masse à une IA de précision capable de comprendre les nuances propres à un secteur ou à une audience spécifique. Cet article explore comment vos données propriétaires deviennent le socle indispensable de cette nouvelle génération d’intelligence artificielle.

La maîtrise de ce cycle de valeur, de la collecte au fine-tuning, définit désormais la frontière entre les entreprises qui subissent l’innovation et celles qui la pilotent. En plaçant la donnée média au cœur de l’entraînement des modèles réduits, les organisations s’assurent non seulement une meilleure efficacité opérationnelle, mais aussi une souveraineté numérique indispensable dans un paysage technologique de plus en plus fragmenté.

Du LLM au SLM : Le basculement vers une IA de précision

L’hégémonie des Large Language Models (LLM) est aujourd’hui remise en question par des impératifs d’efficacité et de rentabilité. Si les modèles géants impressionnent par leur culture générale, ils pèchent souvent par leur manque d’expertise pointue et leurs coûts d’inférence prohibitifs pour des tâches répétitives. Un Small Language Model (SLM), comptant généralement entre 1 et 10 milliards de paramètres, offre une alternative séduisante car il permet une exécution locale, plus rapide et surtout beaucoup moins énergivore. Pour une entreprise, déployer un modèle compact signifie réduire sa latence tout en gardant un contrôle total sur l’infrastructure. Les coûts de calcul peuvent être divisés par dix par rapport à l’utilisation systématique de modèles propriétaires via API, transformant l’IA d’un centre de coût expérimental en un outil de production scalable.

La précision métier devient le critère de succès numéro un dans le conseil en data. Un modèle entraîné sur l’intégralité de Wikipédia sera toujours moins performant pour prédire un comportement d’achat spécifique qu’un modèle réduit ayant ingéré l’historique transactionnel et les parcours de navigation d’une marque. Cette spécialisation permet d’éliminer les hallucinations en limitant le champ de réponse du modèle à un univers de connaissances maîtrisé. Le basculement vers le SLM n’est donc pas une régression technique, mais une optimisation stratégique où l’on privilégie la profondeur à la largeur. En se concentrant sur des tâches définies comme la segmentation prédictive ou l’analyse de sentiment sur des feedbacks clients, ces petits modèles surpassent régulièrement leurs grands frères généralistes.

La First-Party Data : Le seul actif capable de différencier votre IA

Dans un monde où les algorithmes tendent à se standardiser, la donnée propriétaire reste la seule barrière à l’entrée durable. La First-Party Data, issue de vos propres actifs média et de vos plateformes CRM, constitue un gisement d’informations uniques que vos concurrents ne pourront jamais répliquer. Elle capture l’essence même de l’interaction entre votre marque et ses clients, offrant des nuances comportementales qu’aucun dataset public ne contient. Utiliser ces données pour nourrir vos modèles d’IA, c’est s’assurer que l’intelligence produite est alignée avec votre identité de marque et vos objectifs commerciaux. La qualité de la donnée prime ici sur la quantité : un jeu de données propre, labellisé et consenti est infiniment plus précieux que des téraoctets de données tierces au futur incertain.

L’obsolescence programmée des cookies tiers renforce mécaniquement la valeur de ce capital de données internes. Les entreprises qui ont investi dans des stratégies de collecte robuste disposent aujourd’hui d’une avance compétitive majeure pour l’entraînement de leurs Small Models. En intégrant des signaux médias tels que le temps de consultation, les types de contenus consommés ou les interactions avec les campagnes publicitaires, vous créez un cercle vertueux. Le modèle apprend de vos clients réels pour prédire les besoins de vos futurs clients. Cette approche garantit également une conformité native avec les réglementations sur la vie privée, puisque l’IA est entraînée sur des données dont vous maîtrisez la provenance et le consentement associé.

Stratégies d’entraînement : Le rôle central du Fine-Tuning et du RAG

L’exploitation des Small Models repose sur deux piliers techniques complémentaires : le Fine-Tuning et le Retrieval-Augmented Generation (RAG). Le Fine-Tuning consiste à ajuster les poids d’un modèle pré-entraîné en utilisant vos données spécifiques pour lui apprendre votre jargon, vos codes et vos spécificités produits. C’est cette étape de raffinement qui transforme un outil générique en un expert métier. À l’inverse, le RAG permet au modèle d’aller puiser des informations en temps réel dans vos bases de données internes avant de générer une réponse. Cette combinaison assure que l’IA ne se contente pas de prédire le mot suivant, mais qu’elle s’appuie sur une base de connaissances vérifiée et actualisée. La donnée de navigation devient alors une source d’enrichissement contextuel immédiat.

Cette architecture hybride présente un avantage considérable en termes de sécurité et de confidentialité. En utilisant des Small Models hébergés dans votre propre environnement cloud, vos données les plus sensibles ne sortent jamais de votre périmètre de sécurité. Contrairement aux modèles publics où chaque requête peut potentiellement servir à l’entraînement futur du fournisseur, le modèle spécialisé reste votre propriété exclusive. Cette souveraineté sur l’intelligence produite est cruciale pour les industries réglementées ou celles manipulant des secrets commerciaux. Le Small Model devient ainsi le rempart d’une IA de confiance, capable de personnaliser l’expérience utilisateur sans jamais compromettre l’intégrité des données personnelles.

Cas pratiques : Quand l’IA média transforme le business

Les applications concrètes de cette synergie entre données propriétaires et modèles compacts sont déjà visibles chez les leaders du marché.

Prenons l’exemple de l’optimisation du mix-média : l’IA, en exploitant vos propres analyses plutôt que des modèles d’attribution standardisés, devient un outil de performance inégalé. Comment ? En croisant les données de performance média avec les données de stock et de marge réelle issues du CRM. Cette approche permet à l’IA de recommander des réallocations budgétaires en temps réel avec une précision que les outils transversaux classiques ne peuvent atteindre. Le gain de ROI est ici direct et mesurable, car l’algorithme est optimisé pour les indicateurs financiers réels de l’entreprise.

Un autre cas d’usage emblématique réside dans l’automatisation de la personnalisation produit. Un Small Model intégré directement sur un site e-commerce peut analyser le comportement de navigation en cours pour ajuster les recommandations non pas sur la base de profils types, mais selon l’intention immédiate de l’utilisateur. Les performances observées sur ce type de dispositif montrent des taux de conversion nettement supérieurs aux systèmes de recommandation classiques. En transformant le service client par des agents conversationnels alimentés par les données de support historiques et les guides produits internes, les marques réduisent leur charge opérationnelle tout en améliorant la satisfaction client grâce à des réponses immédiates, précises et parfaitement contextualisées.

Conclusion

L’avenir de l’intelligence artificielle en entreprise ne se jouera pas sur la taille des serveurs, mais sur l’intelligence du maillage entre la donnée média et les modèles spécialisés. Les Small Models représentent une opportunité historique pour les marques de reprendre le contrôle de leur stack technologique et de valoriser enfin leurs actifs de données propriétaires à leur juste mesure. En investissant dans la qualité de votre First-Party Data, vous ne vous contentez pas de suivre une tendance, vous construisez un avantage concurrentiel durable et souverain.

Le succès de cette démarche repose sur une collaboration étroite entre les experts métiers, les analystes data et les spécialistes de l’IA. Chez Converteo, nous sommes convaincus que la pertinence d’un modèle d’IA est le reflet direct de la maturité des données qui l’alimentent. Il est désormais temps de transformer votre capital de données en une force de frappe opérationnelle. Pour amorcer cette transition, la première étape consiste à réaliser un audit de votre patrimoine de données afin de déterminer quels sont les segments les plus porteurs pour l’entraînement de vos futurs Small Models.