FinOps : Maîtriser les coûts d’infrastructure liés à l’IA Agentique dans le Retail

L’intelligence artificielle générative a profondément bouleversé les standards de l’expérience client dans le secteur du retail. Face à des consommateurs toujours plus exigeants, les marques déploient des solutions de plus en plus sophistiquées pour personnaliser les parcours d’achat et fluidifier les interactions sur l’ensemble de leurs canaux. L’heure n’est plus aux simples réponses automatisées et génériques, mais à une véritable assistance conversationnelle capable de comprendre les nuances de chaque requête et d’y apporter une réponse précise et contextualisée en temps réel.

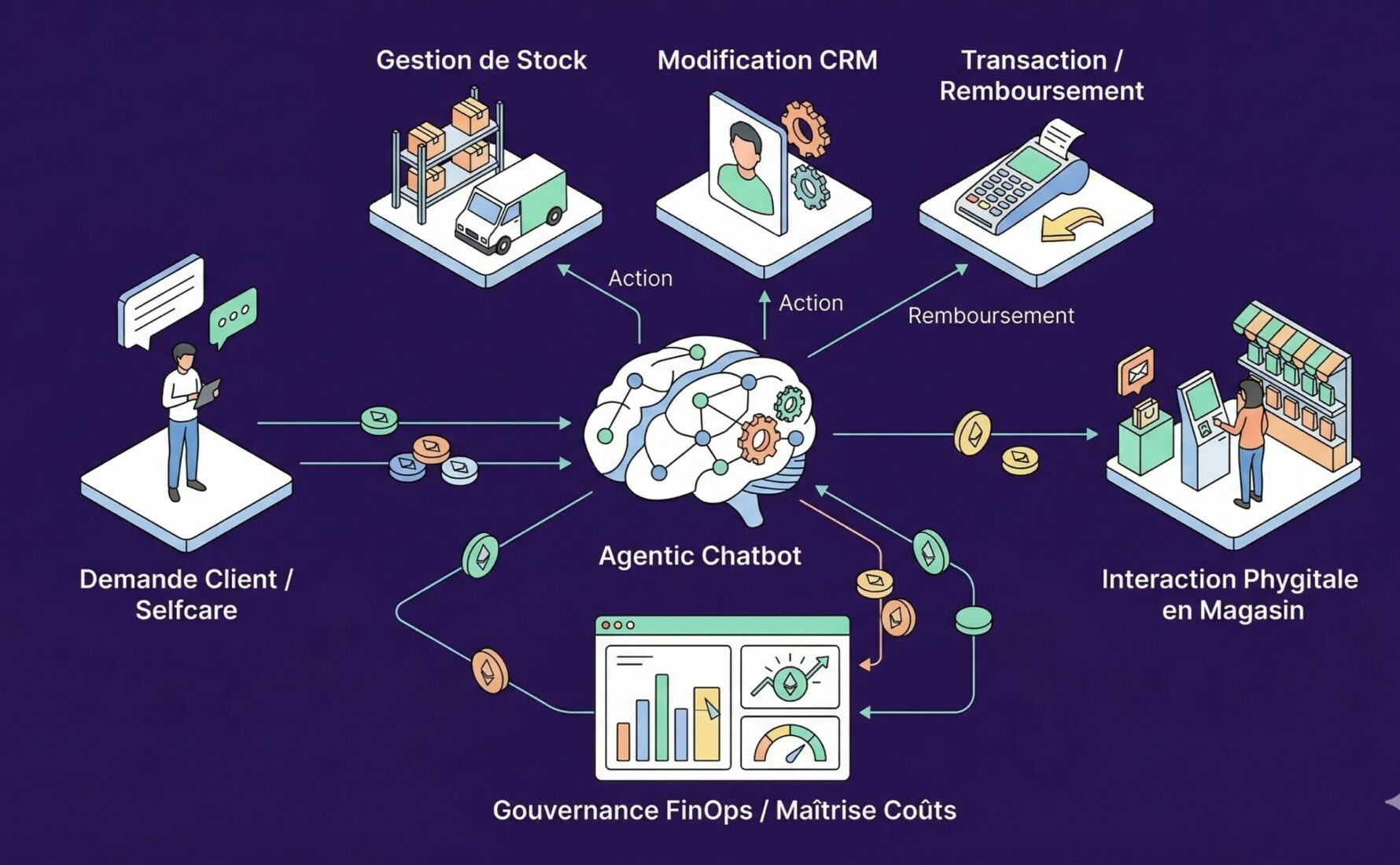

Cette ambition technologique se traduit aujourd’hui par l’émergence de l’IA agentique, une évolution majeure où les systèmes ne se contentent plus de générer du texte, mais planifient et exécutent actions complexes de manière totalement autonome. Cependant, cette transition vers des agents intelligents engendre un défi majeur et souvent sous-estimé par les directions informatiques : l’explosion fulgurante des coûts d’infrastructure. Le traitement continu de données massives nécessite une puissance de calcul colossale qui se répercute directement et violemment sur les budgets alloués au cloud.

C’est précisément ici qu’intervient la discipline du FinOps, qui doit désormais se réinventer en profondeur pour adresser les spécificités de l’intelligence artificielle. Le FinOps IA ne se limite plus à éteindre des serveurs inactifs le week-end ou à négocier des remises d’engagement, il exige une compréhension extrêmement fine de la consommation des modèles de langage, de l’inférence et de la gestion des tokens. Sans cette maîtrise financière rigoureuse, les projets d’IA les plus prometteurs risquent de voir leur rentabilité anéantie par des factures cloud incontrôlables et totalement imprévisibles pour l’entreprise.

Pour naviguer sereinement dans cette nouvelle réalité économique, il est absolument indispensable de structurer une approche méthodique alliant une gouvernance stricte et une optimisation technique continue. Nous explorerons dans un premier temps les raisons pour lesquelles ces agents autonomes pèsent si lourd sur les finances, avant de détailler les principes de collaboration indispensables pour aligner les différentes équipes. Ensuite, nous aborderons les stratégies architecturales concrètes pour réduire la facture sans jamais dégrader l’expérience client, pour enfin comprendre comment piloter et prouver le retour sur investissement de ces innovations dans le commerce de détail.

L’IA agentique dans le retail : une révolution technologique aux coûts exponentiels

La transition des chatbots basiques aux agents autonomes complexes

La transition des chatbots basiques aux agents autonomes complexes représente un saut quantique pour le commerce de détail, mais constitue également un gouffre financier potentiel si l’architecture n’est pas maîtrisée. Historiquement, un chatbot fonctionnait sur des arbres de décision préprogrammés particulièrement simples, avec des coûts d’hébergement prévisibles et totalement marginaux pour l’entreprise. Aujourd’hui, un agent autonome déployé dans un environnement retail peut gérer une réclamation de bout en bout, interroger le système d’inventaire en temps réel, proposer un produit de remplacement parfaitement pertinent selon l’historique d’achat, et procéder finalement au remboursement partiel. Chaque étape de ce raisonnement exige de solliciter des modèles de fondation extrêmement gourmands en ressources de calcul. Cette autonomie, bien qu’elle offre une expérience client exceptionnelle et libère le service client humain des tâches les plus chronophages, multiplie considérablement le nombre d’interactions complexes en arrière-plan avec l’infrastructure logicielle. La prédictibilité budgétaire devient alors un véritable casse-tête pour les équipes financières qui voient les dépenses opérationnelles s’envoler de façon mécanique à chaque nouvelle interaction complexe d’un client.

Pourquoi l’infrastructure des LLM et de l’IA pèse-t-elle si lourd sur la facture cloud ?

Pourquoi l’infrastructure sous-jacente des grands modèles de langage pèse-t-elle si lourd sur la facture cloud des distributeurs ? La réponse réside dans la mécanique même de ces technologies de pointe. Contrairement aux applications logicielles traditionnelles, le coût principal d’un grand modèle de langage ne se situe pas dans son stockage ou son entraînement initial, mais bien dans son utilisation quotidienne de manière répétée, ce que les ingénieurs appellent l’inférence. Selon plusieurs analyses récentes du secteur technologique, l’inférence peut représenter jusqu’à quatre-vingt-dix pour cent du coût total de possession d’un modèle d’intelligence artificielle sur l’ensemble de sa durée de vie opérationnelle. Dans le contexte spécifique du retail, où des milliers de clients peuvent solliciter simultanément l’assistant virtuel pendant des périodes de pointe critiques comme le Black Friday ou les soldes d’hiver, la consommation de tokens explose inévitablement. Un token, qui représente schématiquement une fraction de mot traitée par l’algorithme, constitue l’unité de facturation de base des fournisseurs. Or, l’IA agentique, par sa nature itérative et réflexive, consomme énormément de tokens en entrée pour analyser et mémoriser le contexte global, et en génère tout autant en sortie, faisant tourner les compteurs des géants du cloud computing à une vitesse proprement vertigineuse.

Les principes du FinOps adaptés à l’ère de l’Intelligence Artificielle (GenAI FinOps)

Cartographie, tagging et traçabilité de la consommation des tokens

La cartographie exhaustive, le tagging rigoureux et la traçabilité de la consommation des tokens constituent la première ligne de défense indispensable d’une véritable stratégie d’optimisation des coûts cloud liés à l’IA. Dans un environnement FinOps classique, les ingénieurs associent des balises aux machines virtuelles pour savoir précisément quel département dépense quelle somme à la fin du mois. Avec l’avènement de l’IA agentique, cette granularité analytique doit obligatoirement être poussée à l’extrême. Il devient absolument impératif d’identifier avec précision le coût de chaque appel API en fonction du cas d’usage métier spécifique dans l’environnement retail. Par exemple, il faut être capable d’isoler le coût généré par l’agent d’aide à la conversion déployé sur les fiches produits, de celui généré par l’agent de gestion automatisée des retours du service après-vente. Sans cette traçabilité méticuleuse au quotidien, il est strictement impossible d’identifier les sources de gaspillage ou de détecter rapidement une boucle infinie dans le raisonnement d’un agent autonome, une anomalie qui pourrait vider un budget mensuel complet en seulement quelques heures d’erreurs d’exécution non surveillées.

Mettre en place une gouvernance stricte entre les équipes Data, Tech et Métier

Mettre en place une gouvernance collaborative stricte entre les équipes Data, Tech et les directions Métier est une condition sine qua non pour éviter la dérive budgétaire systémique. L’optimisation financière du cloud n’est pas uniquement un problème d’ingénierie technique, c’est avant tout un changement culturel profond à instaurer dans l’entreprise. Les directions métiers du retail conçoivent des parcours clients qu’elles souhaitent parfaits, la direction des systèmes d’information déploie les modèles pour y répondre, et la direction financière paie la facture, malheureusement souvent a posteriori. Pour briser définitivement ces silos préjudiciables, le FinOps appliqué à l’IA impose la création de comités de pilotage transverses où chaque nouveau projet de déploiement d’un agent autonome fait l’objet d’une analyse de rentabilité préalable et documentée. Les experts du secteur s’accordent à dire que la réussite d’un tel projet repose sur la responsabilisation directe des équipes métiers quant aux coûts induits par leurs exigences de performance brute. Il faut donc instaurer des budgets virtuels alloués par produit IA et des alertes automatisées en temps réel, obligeant ainsi toutes les parties prenantes à dialoguer et à faire des compromis éclairés entre la précision absolue attendue du modèle et son coût d’exploitation réel et quotidien.

Stratégies techniques pour optimiser les coûts de votre IA sans sacrifier la performance

RAG, fine-tuning et choix de modèles : trouver le bon équilibre architectural

L’utilisation intelligente du RAG, le recours parcimonieux au fine-tuning et le choix stratégique de la taille des modèles permettent de trouver le bon équilibre architectural pour maîtriser efficacement les coûts des API. Une erreur d’architecture très fréquente dans l’industrie du retail consiste à utiliser systématiquement le modèle le plus puissant, le plus volumineux et le plus cher du marché pour accomplir des tâches basiques, comme extraire un numéro de commande d’un simple email textuel. La stratégie moderne d’architecture logicielle repose au contraire sur le routage intelligent des requêtes entrantes. Les questions simples des consommateurs sont directement orientées vers des petits modèles open source auto-hébergés ou très peu coûteux, tandis que seuls les raisonnements complexes nécessitant une compréhension fine de l’omnicanalité sont envoyés vers les modèles de pointe de dernière génération. Parallèlement, l’approche par génération augmentée de recherche, communément appelée RAG, permet d’injecter dynamiquement le catalogue produit ou les données du CRM directement dans le contexte du modèle au moment précis de la requête. Cette technique brillante évite d’avoir à réentraîner ou affiner le modèle en permanence avec de nouvelles données, une opération extrêmement onéreuse en termes de puissance de calcul graphique, tout en garantissant des réponses parfaitement exactes, actualisées et sourcées pour le client.

Caching sémantique et gestion intelligente des requêtes clients

Le caching sémantique et la gestion prédictive intelligente des requêtes clients constituent des leviers techniques d’une efficacité absolument redoutable pour faire chuter radicalement la facture liée à l’inférence. Dans le dynamique secteur du commerce de détail, les consommateurs posent très souvent des questions extrêmement similaires, particulièrement autour des problématiques récurrentes comme les délais de livraison en période de fêtes, les politiques d’échange ou les caractéristiques techniques d’un produit phare de la saison. Au lieu de solliciter aveuglément le grand modèle de langage pour générer une nouvelle réponse inédite à chaque sollicitation, le caching sémantique permet de stocker intelligemment la réponse générée de manière satisfaisante lors de la toute première requête. Lorsqu’un second client pose la même question, même si celle-ci est formulée avec des mots légèrement différents, le système identifie instantanément la similarité sémantique et renvoie immédiatement la réponse préalablement stockée en mémoire cache. Cette technique astucieuse court-circuite purement et simplement l’appel coûteux à l’API du fournisseur du modèle d’intelligence artificielle. Les gains opérationnels sont doubles et totalement immédiats : on observe une réduction drastique des coûts d’infrastructure directement liés à la consommation de tokens, couplée à une amélioration spectaculaire du temps de réponse de l’agent virtuel, offrant ainsi une expérience de navigation beaucoup plus fluide et agréable au visiteur de la plateforme e-commerce.

Mesurer et piloter le véritable ROI des agents IA dans le commerce de détail

Aligner les dépenses d’infrastructure sur la valeur métier et la conversion générée

Aligner méthodiquement les dépenses d’infrastructure cloud sur la création de valeur métier et sur la conversion commerciale générée est l’étape ultime de la maturité d’une démarche FinOps réussie. Il ne s’agit plus simplement de réduire aveuglément la facture mensuelle par des coupes budgétaires arbitraires, mais d’optimiser en permanence le rapport direct entre chaque euro investi dans la puissance de calcul informatique et la valeur commerciale concrète qui en est dégagée. Pour évaluer honnêtement la rentabilité globale d’un agent IA, les acteurs majeurs du retail doivent mettre en regard le coût technique précis par session conversationnelle avec les indicateurs de performance clés spécifiques à leur activité de vente. Par exemple, si l’agent autonome coûte dix centimes d’euro par conversation pour fonctionner, mais qu’il parvient à augmenter le panier moyen des utilisateurs grâce à des recommandations ultra-personnalisées ou à réduire le taux global d’abandon de panier de façon significative avant le paiement, l’investissement technologique est alors largement justifié sur le plan financier. À l’inverse, si un agent particulièrement coûteux en ressources de calcul est déployé sur une page informative à très faible enjeu de conversion, sans aucun impact mesurable sur la marge commerciale ou sur la fidélisation client à long terme, la gouvernance FinOps en place devra fortement recommander son déclassement rapide vers une technologie d’automatisation beaucoup moins onéreuse. L’objectif final de cette rigueur financière est de transformer l’intelligence artificielle d’un simple centre de coûts techniques difficile à justifier en un véritable centre de profit mesurable et incontestable pour l’organisation.

La maîtrise totale des coûts d’infrastructure intimement liés au déploiement de l’intelligence artificielle agentique n’est aujourd’hui plus une option négligeable pour les acteurs ambitieux du retail, c’est au contraire une nécessité économique vitale pour assurer la pérennité à long terme de leurs innovations technologiques. En adoptant sans délai une démarche FinOps rigoureuse et adaptée, en instaurant une gouvernance partagée en interne et en appliquant des stratégies architecturales astucieuses comme le routage intelligent des modèles ou le caching sémantique, il est tout à fait possible de concilier une expérience client de très haut niveau avec une rentabilité financière véritablement exemplaire et pérenne.

Avez-vous déjà pris le temps d’évaluer l’impact financier réel de l’inférence sur votre facture cloud actuelle, ou avez-vous mis en place des indicateurs de performance précis pour mesurer le retour sur investissement concret de vos différents agents conversationnels ? Les experts de Converteo vous accompagnent activement dans l’audit approfondi de vos infrastructures Data et IA afin de structurer une démarche d’optimisation financière totalement sur mesure. N’hésitez pas à solliciter nos consultants spécialisés pour transformer intelligemment vos ambitieux déploiements technologiques en véritables leviers de performance économique et commerciale pour votre marque.