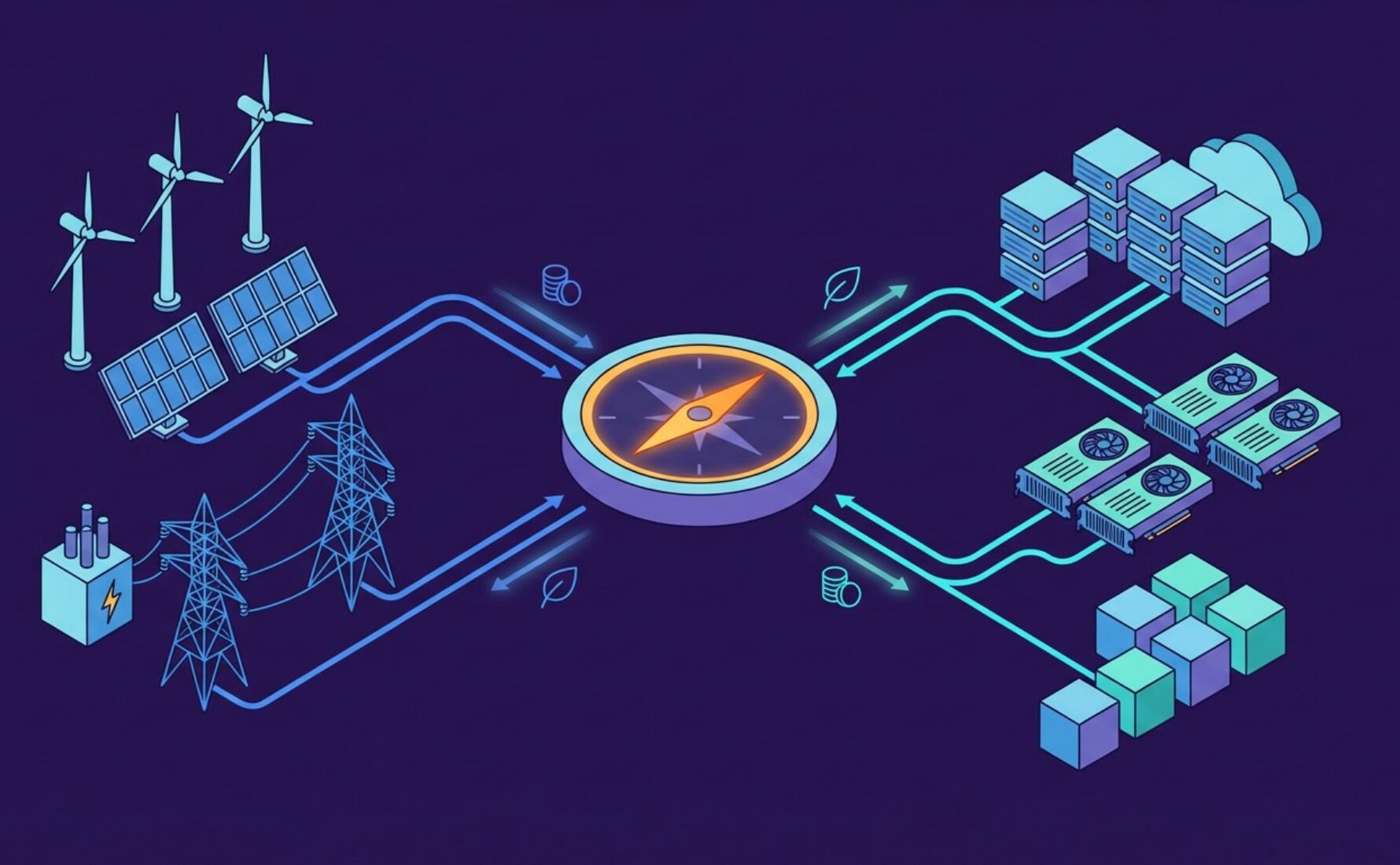

Gestion des infrastructures IA en Energie : Le FinOps comme boussole

L’industrie de l’énergie traverse une mutation profonde où l’intelligence artificielle n’est plus une simple option technologique, mais le moteur principal de l’optimisation des réseaux et de la transition bas carbone. Qu’il s’agisse de maintenance prédictive sur des parcs éoliens ou de pilotage intelligent de la charge sur les réseaux de distribution, les modèles de machine learning deviennent omniprésents. Cette montée en puissance technologique s’accompagne toutefois d’une réalité économique brutale liée à l’explosion des coûts d’infrastructure Cloud et de calcul.

Le paradoxe est frappant pour les acteurs de l’énergie qui doivent concilier une innovation IA gourmande en ressources avec des objectifs de rentabilité de plus en plus stricts et des engagements RSE ambitieux. Le déploiement massif de l’IA générative et des modèles de forecasting de pointe engendre une consommation de ressources GPU sans précédent, rendant les modèles de gestion traditionnels obsolètes. Sans une maîtrise fine de la consommation, les projets pilotes risquent de ne jamais passer l’étape de l’industrialisation faute de viabilité financière.

Face à cette dérive potentielle des budgets, le FinOps appliqué spécifiquement aux infrastructures IA émerge comme la boussole indispensable pour naviguer dans la complexité du Cloud. Cette approche ne se limite plus à une simple réduction des coûts, mais devient une discipline de gestion de la valeur permettant d’aligner les capacités technologiques sur les priorités stratégiques des énergéticiens. En instaurant une culture de responsabilité partagée entre les équipes Data Science, les architectes Cloud et les directions financières, le FinOps transforme la contrainte budgétaire en levier d’agilité.

Ce guide explore comment les entreprises du secteur de l’énergie peuvent structurer leur démarche FinOps pour pérenniser leurs investissements en intelligence artificielle. Nous détaillerons les mécanismes spécifiques de l’optimisation des charges de travail IA, de l’allocation des ressources GPU jusqu’à la convergence nécessaire avec les objectifs de sobriété numérique. L’enjeu est clair pour les décideurs : passer d’une logique de consommation subie à une stratégie de performance pilotée par la donnée et l’efficacité opérationnelle.

Les spécificités du FinOps appliqué aux workloads IA

La gestion financière des projets d’intelligence artificielle dans le secteur de l’énergie présente des défis radicalement différents des applications SaaS classiques. La structure de coût est principalement dictée par deux phases critiques : l’entraînement des modèles et leur inférence en production. Pour un gestionnaire de réseau utilisant des algorithmes de deep learning pour prévoir la consommation à la maille locale, la phase d’entraînement peut représenter des pics de dépense massifs sur de courtes périodes, tandis que l’inférence continue nécessite une disponibilité constante de ressources de calcul spécialisées.

Comprendre le coût de l’inférence est devenu une priorité absolue, car cette dépense est récurrente et directement corrélée au volume de données traitées en temps réel par les capteurs intelligents. Dans le domaine de l’énergie, où les flux de données provenant de millions de compteurs communicants sont permanents, une mauvaise configuration de l’infrastructure d’inférence peut entraîner des surcoûts se chiffrant en dizaines de milliers d’euros par mois. Le FinOps permet ici d’introduire des mécanismes de scalabilité automatique plus fins, ajustant la puissance de calcul non plus seulement sur le trafic réseau, mais sur la complexité des modèles sollicités.

Le véritable nerf de la guerre réside dans la gestion des unités de traitement graphique, les GPU, dont la disponibilité sur le marché du Cloud reste tendue et le prix unitaire élevé. Passer du mode « Nice to have » au « Must optimize » implique une remise en question de l’allocation des ressources : tous les modèles n’ont pas besoin des GPU les plus performants du marché en permanence. Une stratégie FinOps mature impose de catégoriser les charges de travail pour réserver les instances les plus coûteuses aux tâches de recherche critiques, tout en utilisant des instances préemptibles ou des processeurs moins onéreux pour les tâches de routine.

Transformer l’infrastructure IA en levier de performance sectorielle

L’efficacité d’un projet IA dans l’énergie se mesure désormais à son ratio valeur métier sur coût d’infrastructure. Pour optimiser ce ratio, le right-sizing des modèles de prédiction énergétique est une étape fondamentale souvent négligée lors des phases de développement. Il ne s’agit pas seulement de réduire la taille des serveurs, mais d’adapter la précision du modèle à son utilité réelle : un modèle de prévision météo pour le solaire n’a pas nécessairement besoin d’une précision au centième de degré si cela double son coût d’infrastructure sans améliorer significativement la décision opérationnelle.

La mise en place d’une visibilité en temps réel sur la consommation Cloud est le pilier technique qui permet de transformer ces intentions en résultats concrets. Les tableaux de bord doivent permettre aux Data Engineers de visualiser instantanément l’impact financier de chaque modification d’architecture ou de chaque nouvelle version de modèle mise en production. Cette transparence favorise l’autonomie des équipes techniques qui deviennent capables d’arbitrer elles-mêmes entre performance algorithmique et efficacité budgétaire, évitant ainsi les mauvaises surprises lors de la réception de la facture mensuelle.

Un exemple concret peut être observé lors de l’optimisation d’un modèle de forecasting de réseau de distribution électrique. En passant d’une architecture monolithique sur des instances gourmandes à une architecture serverless ou containerisée optimisée pour l’IA, certains acteurs ont réussi à réduire leurs coûts opérationnels de 30% tout en conservant une réactivité identique. Cette approche permet de réinvestir les économies réalisées dans le développement de nouveaux cas d’usage, créant ainsi un cercle vertueux d’innovation autofinancée par l’optimisation continue de l’existant.

Vers une convergence FinOps et GreenOps pour l’Énergie

Dans le secteur de l’énergie, la performance financière ne peut plus être dissociée de la performance environnementale. La réduction de la facture Cloud grâce au FinOps se traduit presque systématiquement par une baisse de la consommation électrique des centres de données, créant une synergie naturelle avec les démarches de sobriété numérique. En optimisant le code des algorithmes et en supprimant les ressources de calcul inutilisées, les entreprises agissent simultanément sur leur rentabilité et sur leur empreinte carbone, un point crucial pour les rapports ESG.

Le choix des régions Cloud devient un levier stratégique majeur à l’intersection du coût et de l’impact carbone. Le FinOps moderne intègre désormais des données sur le mix énergétique des différentes zones géographiques proposées par les fournisseurs de Cloud. Pour des calculs d’IA massifs non urgents, il est possible de déplacer les charges de travail vers des centres de données alimentés par des énergies bas carbone à des moments où les tarifs sont plus avantageux. Cette approche permet de concilier les impératifs de décarbonation du secteur de l’énergie avec une gestion budgétaire rigoureuse.

La responsabilité numérique devient ainsi une compétence clé pour les architectes de demain. Comme le soulignent de nombreux experts du secteur, l’IA ne doit pas devenir une dette environnementale que les énergéticiens ne pourraient plus porter. En adoptant le FinOps comme une discipline de pilotage globale, les entreprises s’assurent que chaque watt consommé par leurs infrastructures IA génère une valeur réelle pour le système énergétique global. Cette vision intégrée est la seule capable de garantir que l’intelligence artificielle restera un allié de la transition énergétique sur le long terme.

L’adoption du FinOps comme boussole pour les infrastructures IA n’est plus une simple mesure d’économie, mais une nécessité stratégique pour tout acteur de l’énergie souhaitant passer à l’échelle. En structurant la visibilité, en optimisant l’allocation des ressources GPU et en unifiant les objectifs financiers et environnementaux, les organisations transforment leurs coûts technologiques en un avantage compétitif durable. Pour réussir cette transition, la mise en place d’un centre d’excellence Cloud incluant les métiers de la Data est la prochaine étape logique pour garantir la pérennité de l’innovation.