Score de crédit : Pourquoi les Banques préfèrent les Small Models aux LLM

L’ascension fulgurante de l’intelligence artificielle générative a bousculé les certitudes des directions de l’innovation au sein du secteur financier. Pendant des mois, la course au gigantisme, dictée par des modèles de langage comptant des centaines de milliards de paramètres, semblait être l’unique voie vers un investissement technologique de pointe. Les banques de détail et les banques d’investissement ont observé avec une fascination mêlée de prudence les capacités conversationnelles de modèles comme GPT-4 ou Claude, imaginant immédiatement des applications pour la relation client ou la synthèse de documents juridiques complexes.

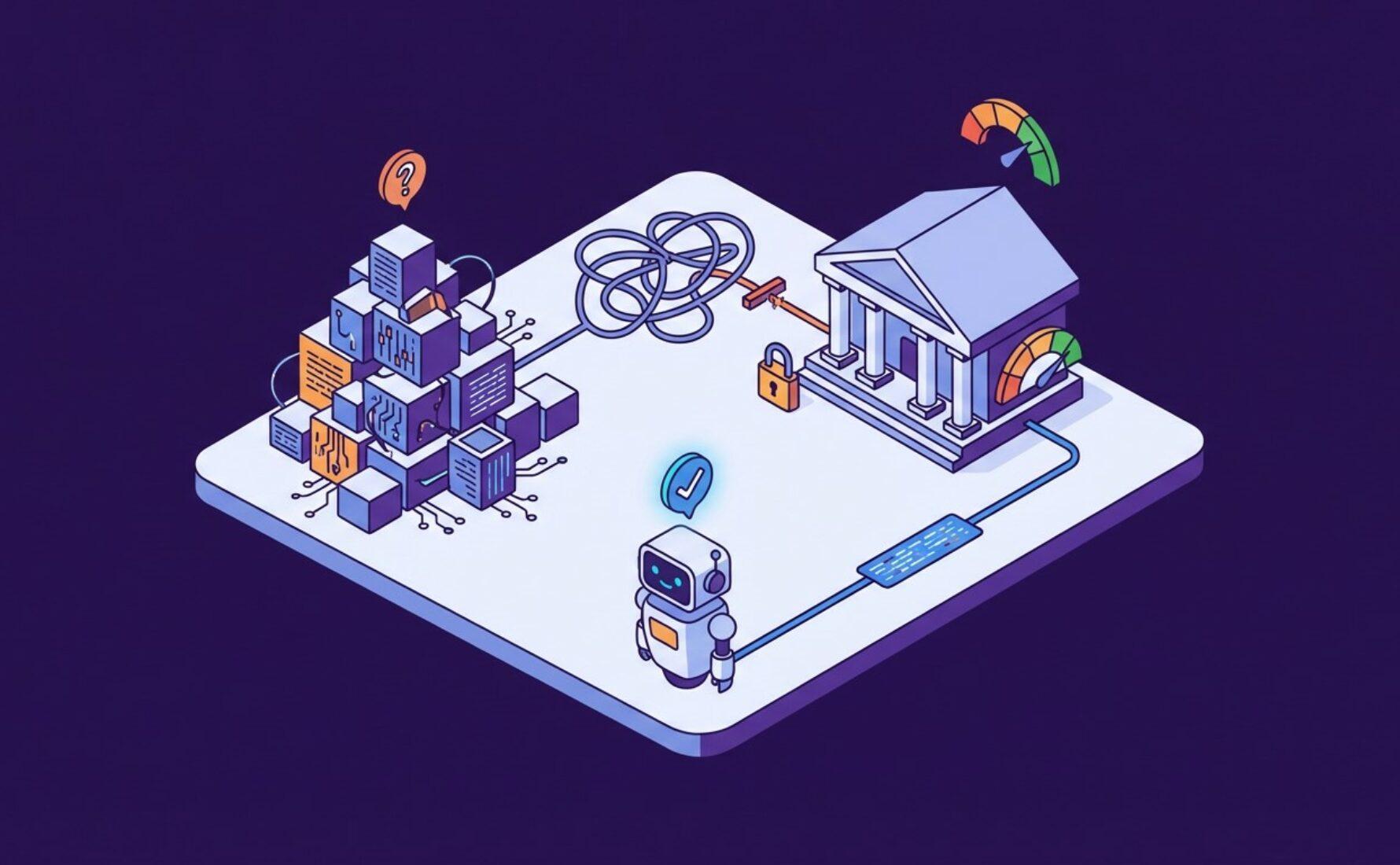

Pourtant, dès que l’on quitte le terrain du front-office pour s’aventurer dans le moteur de l’activité bancaire, à savoir le scoring de crédit, l’enthousiasme pour les Large Language Models (LLM) se heurte à une réalité opérationnelle implacable. Le score de crédit ne tolère aucune approximation, aucune hallucination et surtout aucune opacité algorithmique. Dans ce sanctuaire où se décide l’octroi d’un prêt immobilier ou d’une ligne de trésorerie pour une entreprise, les institutions financières font aujourd’hui un choix stratégique à contre-courant du battage médiatique en privilégiant les Small Language Models (SLM).

Ce basculement vers des modèles plus compacts et spécialisés ne doit rien au hasard ni à une quelconque frilosité technologique de la part des risk managers. Il s’agit d’une réponse structurelle aux exigences de régulateurs de plus en plus scrupuleux sur l’explicabilité des décisions automatisées. Alors que les géants de l’IA fonctionnent souvent comme des boîtes noires indéchiffrables, les modèles de taille réduite offrent une transparence de calcul indispensable pour justifier un refus de crédit auprès d’un client ou d’une autorité de contrôle.

Converteo accompagne quotidiennement les acteurs majeurs de la finance dans cette transition vers une IA plus frugale mais nettement plus souveraine. L’enjeu n’est plus seulement de disposer de la technologie la plus puissante dans l’absolu, mais de déployer celle qui présente le meilleur ratio entre performance prédictive, coût d’infrastructure et sécurité des données sensibles. En se tournant vers les SLM, le secteur bancaire définit un nouveau standard d’intelligence métier, où la pertinence d’un modèle se mesure à sa capacité à maîtriser un domaine spécifique plutôt qu’à sa connaissance encyclopédique du monde.

L’impératif de l’interprétabilité demeure le premier pilier de cette préférence marquée pour les modèles compacts dans le processus de décision de crédit. Pour une banque, l’utilisation d’un modèle de langage massif pose un problème juridique majeur car il est techniquement impossible de tracer avec précision le cheminement logique ayant conduit à un score spécifique. Or, le cadre réglementaire européen, notamment avec l’entrée en vigueur de l’AI Act, impose une transparence totale sur les systèmes classés à haut risque. Un Small Language Model, entraîné sur des jeux de données plus restreints et ciblés, permet une analyse des poids et des variables beaucoup plus fine. Cette auditabilité native garantit que le score attribué repose sur des critères financiers tangibles et non sur des corrélations statistiques fortuites ou des biais cognitifs hérités d’un entraînement sur l’internet global.

Au-delà de la conformité, la réalité économique de l’inférence joue un rôle déterminant dans l’arbitrage technologique des départements data. Faire tourner un LLM de 175 milliards de paramètres pour chaque demande de crédit représenterait un coût énergétique et financier colossal pour une banque traitant des millions de dossiers par an. À l’inverse, un modèle de type Mistral 7B ou Phi-3, une fois optimisé et quantifié, peut être déployé sur des infrastructures beaucoup plus légères avec une latence quasi nulle. Cette efficacité opérationnelle permet d’intégrer l’IA directement au cœur du parcours client en temps réel, sans faire exploser les budgets de cloud computing. Les gains en termes de ROI sont immédiats, car la précision d’un petit modèle finement ajusté sur des données bancaires historiques surpasse souvent celle d’un modèle généraliste sur ce type de tâche verticale.

La sécurité et la souveraineté des données constituent le troisième argument de poids en faveur de cette approche. Le secret bancaire et la protection des données personnelles ne font pas bon ménage avec l’envoi de flux d’informations vers des API tierces gérées par des acteurs extra-européens. En optant pour des Small Models, les banques retrouvent la capacité de réaliser le déploiement on-premise, c’est-à-dire directement sur leurs propres serveurs sécurisés. Cette autonomie technique élimine les risques de fuites de données et permet de conserver l’intégralité du patrimoine data au sein de l’organisation. L’entraînement d’un modèle spécifique sur des historiques de transactions propres à l’institution crée alors un actif stratégique unique, impossible à répliquer par la concurrence et parfaitement aligné avec les spécificités du marché local.

En conclusion, la stratégie des banques face à l’intelligence artificielle s’oriente vers une spécialisation pragmatique. Le recours aux Small Language Models pour le scoring de crédit illustre une maturité croissante : l’heure n’est plus à l’expérimentation spectaculaire mais à l’intégration de solutions robustes, explicables et économiquement viables. Cette trajectoire vers une IA de confiance permet de concilier l’innovation technologique avec les fondamentaux du métier de banquier que sont la gestion du risque et la protection du client. Pour les directions data, le défi consiste désormais à valoriser la donnée brute en une valeur décisionnelle immédiate et sécurisée.