Sécurité des fondations Data en Énergie : Préparer le terrain pour les agents autonomes

Le secteur de l’énergie traverse actuellement une transformation numérique sans précédent, propulsée par l’urgence de la transition écologique et l’optimisation des ressources. Au cœur de cette révolution industrielle, l’intelligence artificielle générative et les modèles d’apprentissage automatique s’imposent comme des leviers incontournables. Les opérateurs énergétiques investissent massivement pour moderniser leurs infrastructures, cherchant à tirer parti de chaque téraoctet d’information généré par leurs réseaux.

La promesse technologique la plus ambitieuse réside aujourd’hui dans le déploiement d’agents autonomes. Ces systèmes intelligents, capables non seulement d’analyser des environnements complexes mais aussi de prendre des décisions en temps réel sans intervention humaine, représentent le futur de la gestion énergétique. Qu’il s’agisse d’équilibrer la charge d’un smart grid, d’anticiper les pannes sur des éoliennes offshore ou d’optimiser la distribution d’électricité, ces agents ont le potentiel de redéfinir entièrement la chaîne de valeur.

Cependant, un paradoxe majeur freine encore cette ambition algorithmique : la réalité des dettes techniques et l’obsolescence des architectures de données existantes. De nombreux projets d’intelligence artificielle se heurtent à un mur lorsqu’ils passent de la phase d’expérimentation à la production, bloqués par des vulnérabilités de sécurité béantes et une qualité de l’information largement insuffisante. L’enthousiasme pour l’innovation masque souvent la fragilité des fondations sous-jacentes.

C’est ici que réside le défi principal des prochaines années pour les acteurs de l’industrie. La sécurisation rigoureuse des fondations Data n’est plus une simple option de conformité, c’est le prérequis absolu pour garantir l’autonomie algorithmique. Déployer des agents autonomes sur des socles instables expose les infrastructures critiques à des risques industriels, financiers et sécuritaires incalculables. Il est donc impératif de consolider ce socle avant de déléguer la prise de décision à la machine.

1. Les enjeux de sécurité Data dans un secteur énergétique en mutation

L’industrie énergétique a longtemps opéré dans des environnements fermés, où la sécurité physique primait sur la sécurité informatique. Aujourd’hui, la numérisation massive des réseaux de distribution et de production bouleverse cet équilibre précaire. L’ouverture des systèmes d’information vers le cloud et l’intégration de capteurs connectés transforment fondamentalement la gestion des risques. Bâtir une gouvernance des données énergie robuste nécessite de comprendre en profondeur ces nouvelles vulnérabilités structurelles qui menacent directement la stabilité des opérations quotidiennes.

1.1. Convergence IT/OT : la nouvelle surface d’attaque des infrastructures critiques

Historiquement, les technologies de l’information (IT), gérant les données d’entreprise, et les technologies opérationnelles (OT), pilotant les équipements industriels, fonctionnaient de manière totalement isolée. Cette séparation étanche agissait comme une barrière de sécurité naturelle contre les intrusions externes. Avec l’avènement de l’industrie 4.0 et de la maintenance prédictive, cette frontière s’est effacée pour permettre aux algorithmes d’analyser les données de production en temps réel. Cette convergence IT/OT, bien qu’essentielle pour l’innovation, a considérablement élargi la surface d’attaque des opérateurs. Les cybercriminels ciblent désormais les failles des réseaux informatiques classiques pour rebondir vers les systèmes de contrôle industriels. Une compromission des données au niveau IT peut ainsi se traduire par des arrêts de production dévastateurs au niveau OT, exigeant une approche de cybersécurité architecture data unifiée et extrêmement résiliente.

1.2. De la donnée silotée à la donnée interconnectée : un changement de paradigme

Pendant des décennies, l’information au sein des groupes énergétiques était fragmentée, conservée dans des silos applicatifs hermétiques propres à chaque métier ou zone géographique. La volonté d’exploiter l’intelligence artificielle a forcé le décloisonnement de ces informations vers des lacs de données centralisés ou des architectures distribuées. Ce passage de la donnée silotée à la donnée interconnectée est un bouleversement majeur. S’il permet de croiser des variables complexes pour affiner les modèles prédictifs, il centralise également les risques. Une brèche de sécurité dans un référentiel interconnecté expose instantanément une part colossale du patrimoine intellectuel et opérationnel de l’entreprise. La sécurisation des pipelines de données devient dès lors un exercice d’équilibriste complexe : il faut garantir une fluidité d’accès pour les data scientists tout en instaurant des contrôles draconiens pour prévenir les fuites et les exfiltrations massives.

2. Agents autonomes : pourquoi ils exigent des fondations Data irréprochables

Contrairement aux outils d’analyse traditionnels qui se contentent de recommander des actions à des opérateurs humains, les agents autonomes agissent directement sur leur environnement. Cette capacité d’action directe modifie radicalement le niveau d’exigence requis pour les infrastructures sous-jacentes. La moindre anomalie non détectée n’est plus seulement une erreur de reporting, elle devient une action erronée aux conséquences physiques immédiates. La fiabilité des modèles algorithmiques dépend donc intégralement de la pureté et de la protection du carburant qui les alimente.

2.1. L’impact de la qualité et de la fiabilité des données sur la prise de décision de l’IA

La pertinence d’un agent IA est intrinsèquement liée à la qualité des flux qu’il ingère en continu. Prenons l’exemple concret d’un agent autonome chargé de l’équilibrage d’un smart grid régional. Ce système ajuste instantanément la distribution électrique en fonction des prévisions météorologiques, de la production solaire et de la demande des foyers. Si les capteurs transmettent des informations corrompues, retardées ou incomplètes en raison d’une défaillance réseau ou d’une mauvaise architecture, l’agent prendra des décisions inadaptées. Cela peut mener à des surcharges du réseau, voire à des coupures de courant à grande échelle. La qualité des données pour IA n’est donc pas qu’un concept abstrait d’hygiène numérique, c’est la condition sine qua non de la sécurité industrielle. Sans un contrôle qualité rigoureux et automatisé à la source, l’autonomie algorithmique devient un danger opérationnel.

2.2. Prévenir les risques de manipulation (Data Poisoning) et d’hallucination

Au-delà des erreurs techniques involontaires, les agents autonomes sont particulièrement vulnérables aux attaques sophistiquées visant délibérément à corrompre leur apprentissage. Le « Data Poisoning », ou empoisonnement des données, consiste pour un attaquant à injecter de fausses informations dans les bases d’entraînement pour modifier discrètement le comportement de l’algorithme. Dans le secteur énergétique, manipuler les historiques de consommation pourrait pousser une IA à sous-évaluer les besoins futurs de manière critique. De plus, la protection des données critiques doit empêcher les phénomènes d’hallucination, où l’agent génère des réponses ou des actions aberrantes fondées sur des corrélations trompeuses. Sécuriser les fondations signifie mettre en place une traçabilité cryptographique absolue depuis la création de la donnée jusqu’à son ingestion par le modèle, garantissant ainsi son intégrité inaltérable.

3. Comment bâtir une architecture Data sécurisée pour l’IA dans l’énergie ?

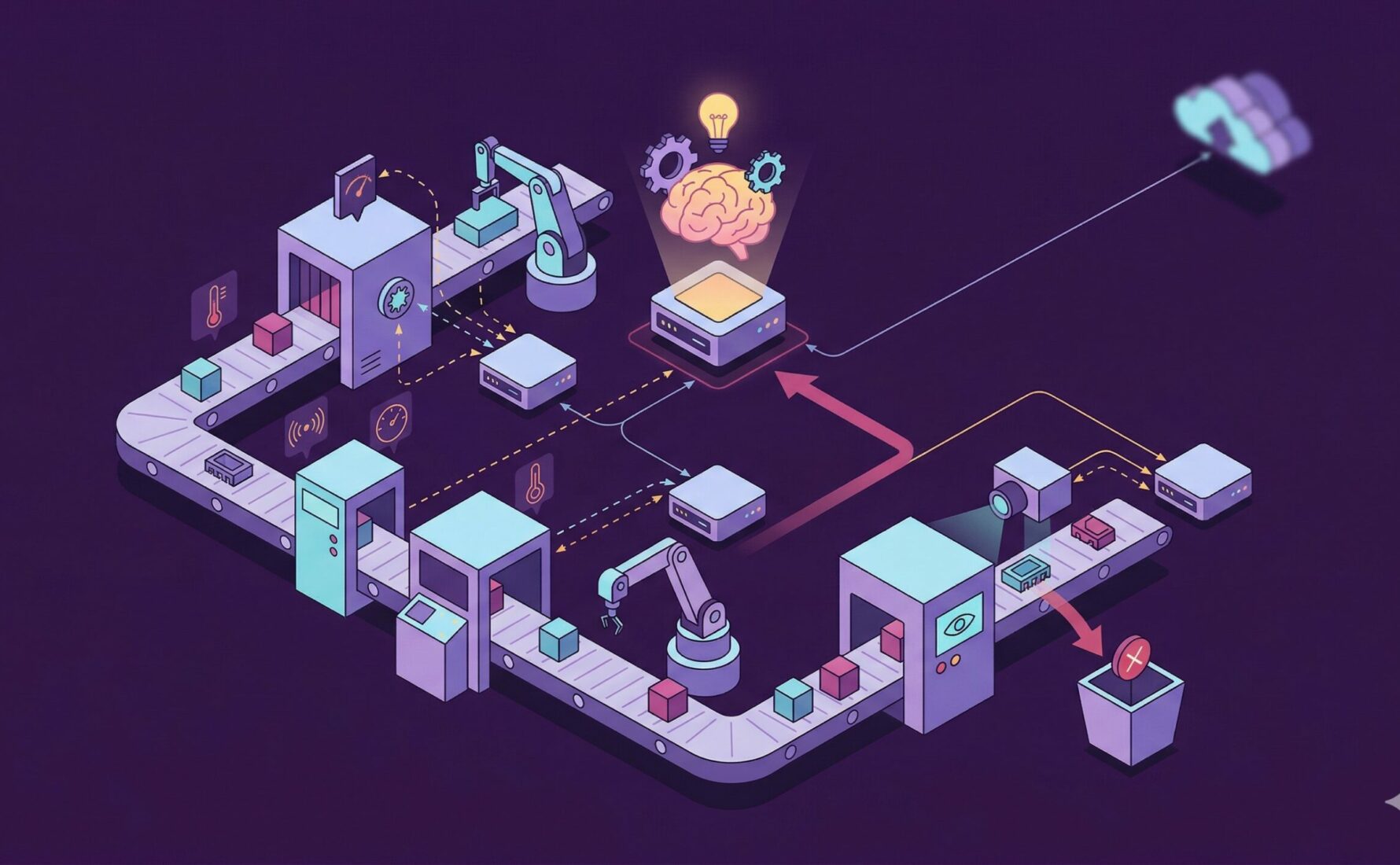

[Suggestion d’intégration visuelle : Schéma illustrant une architecture hybride sécurisée, de la collecte IoT jusqu’à l’interface de l’agent autonome, avec les couches de chiffrement mises en évidence]

Face à ces menaces polymorphes, les approches traditionnelles de cybersécurité périmétrique, qui consistent à ériger des murs autour de l’entreprise, sont devenues obsolètes. La mobilité des données, l’utilisation massive du cloud et l’ouverture aux partenaires exigent une refonte totale de la conception architecturale. Il s’agit de penser la sécurité non plus comme une surcouche imposée a posteriori, mais comme une composante intégrée dès l’origine du design technologique, capable de s’adapter dynamiquement aux besoins de l’intelligence artificielle.

3.1. Implémenter une gouvernance stricte et une approche « Zero Trust »

La pierre angulaire d’une fondation data sécurisée réside dans l’adoption systématique d’une architecture « Zero Trust », ou confiance zéro. Ce modèle postule qu’aucun utilisateur, qu’aucune application et qu’aucun agent algorithmique ne doit être cru sur parole, même s’il se trouve déjà à l’intérieur du réseau d’entreprise. Chaque demande d’accès doit être systématiquement authentifiée, autorisée et chiffrée. Comme le soulignent fréquemment les experts en architecture chez Converteo, le Zero Trust n’est pas simplement une solution technologique que l’on achète sur étagère, c’est un profond changement culturel impliquant une gouvernance des identités sans faille. En énergie, cela signifie qu’un algorithme prédictif souhaitant accéder aux relevés de compteurs communicants devra prouver son identité à chaque requête, limitant drastiquement les mouvements latéraux en cas de compromission d’un sous-système.

3.2. Moderniser les pipelines : vers des socles technologiques résilients (Data Mesh, Lakehouse)

Pour soutenir la charge imposée par l’IA générative énergie sans sacrifier la sécurité, les infrastructures doivent impérativement se moderniser. Les approches monolithiques laissent place à des architectures distribuées de type Data Mesh, où la propriété et la sécurisation des données sont décentralisées au plus près des domaines métiers producteurs, tout en obéissant à des standards de sécurité fédérés stricts. En parallèle, les architectures de type Lakehouse fusionnent la flexibilité des lacs de données avec la rigueur et les garanties transactionnelles des entrepôts classiques. Ces socles technologiques résilients permettent d’appliquer des politiques de chiffrement avancé en mouvement et au repos, d’anonymiser les informations sensibles à la volée, et d’assurer une ségrégation fine des environnements d’entraînement et de production algorithmique.

4. La méthodologie Converteo : un déploiement IA sécurisé de bout en bout

Accompagner les leaders de l’énergie dans cette transition critique exige une expertise située à la croisée exacte de la stratégie d’entreprise, de l’ingénierie des données et de la cybersécurité. Le cabinet de conseil Converteo déploie une approche pragmatique et éprouvée pour s’assurer que les initiatives autour de l’intelligence artificielle ne soient jamais ralenties ou compromises par des failles structurelles. Notre objectif est de transformer la sécurité en un véritable catalyseur de performance algorithmique.

4.1. Cartographie, audit de maturité et sécurisation by design

La première phase de tout accompagnement réussi débute par un audit de sécurité data exhaustif et une cartographie précise de l’existant. Nos équipes interviennent pour évaluer la maturité réelle des infrastructures en place face aux exigences spécifiques des agents autonomes. Cela inclut l’analyse des flux d’informations, l’identification des données fantômes non répertoriées, et l’évaluation des contrôles d’accès actuels. Sur la base de ce diagnostic approfondi, nous co-construisons une feuille de route technique visant à appliquer le principe de « Security by Design ». Les pipelines de traitement, les espaces de stockage et les environnements d’exécution des modèles d’IA sont restructurés pour intégrer nativement les standards de sécurité les plus élevés, garantissant ainsi une conformité totale avec les régulations européennes et industrielles.

4.2. Passer du PoC au passage à l’échelle sans compromettre la sécurité

La difficulté majeure rencontrée par les opérateurs énergétiques n’est souvent pas la réalisation d’une preuve de concept isolée, mais bien l’industrialisation des solutions à l’échelle de l’entreprise. Converteo sécurise cette phase critique de passage à l’échelle, ou « Scale », en implémentant des pratiques robustes de Machine Learning Operations (MLOps) couplées à des contrôles de sécurité continus. Nous automatisons le déploiement des modèles, la surveillance de leur comportement en temps réel et la détection précoce des dérives ou des tentatives de manipulation algorithmique. En fiabilisant la chaîne de production de bout en bout, nous permettons à nos clients de déployer sereinement leurs agents autonomes, libérant ainsi tout le potentiel de la donnée pour relever les défis énergétiques de demain.

Questions Fréquentes sur la sécurisation des données énergétiques

Quel est le premier pas incontournable pour sécuriser les données avant un projet IA ? La démarche initiale la plus critique consiste à réaliser un audit complet de la gouvernance actuelle et de l’architecture existante. Il est indispensable de cartographier précisément où se trouvent les informations sensibles, qui y a accès, et par quels canaux elles transitent avant d’envisager d’alimenter un algorithme.

Qu’est-ce qu’un agent autonome dans le secteur de l’énergie concrètement ? Il s’agit d’un système d’intelligence artificielle avancé, capable d’analyser son environnement via de multiples sources d’informations, de formuler des scénarios d’action et d’exécuter des décisions de manière indépendante pour optimiser une opération. Cela inclut par exemple la régulation automatique de la tension sur un réseau ou l’achat prédictif d’énergie sur les marchés boursiers.

Pourquoi le concept de Zero Trust est-il particulièrement pertinent pour les industriels ? Le Zero Trust répond parfaitement à la dissolution des frontières traditionnelles de l’entreprise. Les opérateurs gérant des milliers d’équipements connectés dispersés géographiquement ne peuvent plus se contenter de protéger leur réseau central. Il faut sécuriser chaque interaction de manière individuelle et systématique.

Conclusion

L’intégration de l’intelligence artificielle et des agents autonomes au sein du secteur énergétique marque un tournant décisif vers des opérations plus efficientes, prédictives et durables. Toutefois, cette puissance technologique reste une coquille vide, voire un danger imminent, si elle repose sur des fondations fragiles. Sécuriser les architectures, implémenter une gouvernance rigoureuse et garantir l’intégrité absolue des flux d’informations ne sont pas de simples contraintes techniques. Ce sont les véritables pré requis qui permettent de transformer la donnée brute en un levier d’action autonome et de confiance. Pour libérer sereinement ce potentiel d’innovation, il est crucial d’être accompagné par des experts capables de lier ingénierie avancée et vision stratégique. Nous vous invitons à contacter les équipes Data & IA de Converteo pour auditer vos infrastructures actuelles et préparer solidement le terrain à vos futurs agents autonomes.