Analyse des appels d’offres industriels : LLM ou modèles locaux spécialisés ?

Le traitement des appels d’offres dans le secteur industriel représente un investissement chronophage colossal pour les équipes commerciales et techniques. Face à des cahiers des charges qui dépassent régulièrement les centaines de pages, l’extraction manuelle des exigences techniques, juridiques et financières ralentit considérablement la prise de décision. Cette lenteur administrative pèse lourdement sur la réactivité des entreprises et grève leur compétitivité sur des marchés où la vitesse de réponse est souvent un critère de différenciation majeur.

Heureusement, l’émergence fulgurante de l’intelligence artificielle générative bouleverse aujourd’hui cette dynamique historique en offrant des capacités d’analyse textuelle inédites. Les technologies de traitement du langage naturel permettent désormais de disséquer ces documents volumineux en quelques instants, identifiant les clauses critiques et synthétisant les attentes des donneurs d’ordre. Cette révolution technologique transforme une contrainte administrative épuisante en un véritable levier de performance commerciale et opérationnelle.

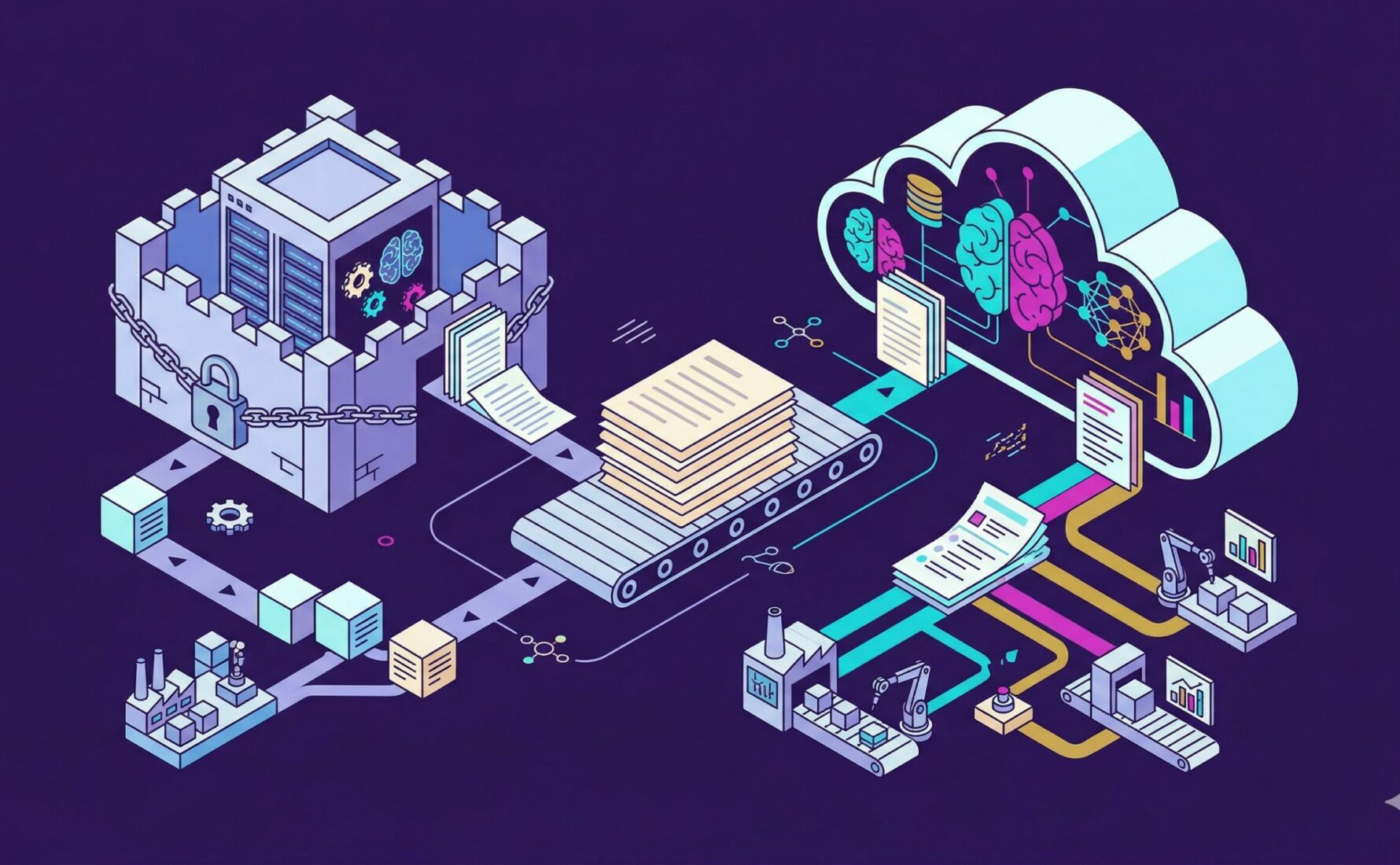

Cependant, l’intégration de ces outils soulève un dilemme architectural et stratégique fondamental pour les directions des systèmes d’information et les directions générales. Faut-il s’en remettre à la puissance prodigieuse des grands modèles de langage hébergés dans le cloud public, ou privilégier le déploiement de modèles locaux spécialisés fonctionnant en circuit fermé au sein de l’infrastructure de l’entreprise ? Cette question cristallise toutes les tensions entre l’innovation technologique rapide et les impératifs de sécurité.

Cet arbitrage complexe exige une évaluation minutieuse des besoins spécifiques de chaque organisation industrielle. En mettant en balance la puissance de calcul, la confidentialité des données stratégiques et la précision de l’analyse technique, il est possible de concevoir une approche sur mesure. Cet article explore en profondeur les avantages et les limites de chaque paradigme afin de vous guider vers la solution la plus adaptée à votre contexte concurrentiel et à vos exigences de souveraineté.

Les défis colossaux de l’analyse des cahiers des charges dans l’industrie

Décrypter la complexité technique en un temps record

Dans le domaine industriel, répondre à un appel d’offres implique invariablement de mobiliser une armada d’ingénieurs, de juristes et d’experts financiers pour éplucher une documentation d’une densité exceptionnelle. Les études montrent que les équipes consacrent en moyenne près de trente pour cent de leur temps de travail à la seule phase de qualification et d’extraction des exigences contenues dans ces documents massifs. Cette tâche ingrate et répétitive augmente le risque d’erreur humaine, notamment l’oubli d’une norme technique spécifique ou d’une pénalité de retard dissimulée dans les annexes juridiques. L’enjeu majeur réside donc dans la capacité à accélérer drastiquement cette phase de lecture pour se concentrer sur l’ingénierie de la solution et la stratégie de tarification, véritables créateurs de valeur ajoutée pour remporter le marché.

Le mur de la confidentialité : protéger le secret industriel

Parallèlement à la complexité technique, le secteur industriel est soumis à des contraintes de confidentialité d’une extrême rigueur. Les cahiers des charges et les propositions commerciales qui en découlent regorgent de propriétés intellectuelles sensibles, de secrets de fabrication, d’innovations non brevetées et de stratégies de prix hautement confidentielles. Transférer ces données critiques vers des serveurs externes pour les faire analyser par une intelligence artificielle tierce expose l’entreprise à des risques majeurs de fuite d’informations ou d’espionnage industriel. La conformité aux réglementations strictes, telles que le règlement général sur la protection des données ou les normes de sécurité spécifiques au secteur de la défense et de l’aéronautique, impose une vigilance absolue quant à l’hébergement et au traitement de ces flux documentaires stratégiques.

Les LLM généralistes en Cloud : Puissance de synthèse et flexibilité

Une capacité d’extraction d’informations inégalée

Les grands modèles de langage hébergés dans le cloud public, développés par les géants de la technologie, offrent une puissance de calcul et une polyvalence sémantique véritablement bluffantes. Grâce à des milliards de paramètres entraînés sur des corpus de données gigantesques, ces outils excellent dans la compréhension du langage naturel et la synthèse de textes longs. Ils sont capables d’ingérer un appel d’offres de plusieurs centaines de pages et d’en restituer un résumé analytique structuré en l’espace de quelques secondes. L’avantage principal de cette approche réside dans sa très grande facilité de déploiement, ne nécessitant aucun investissement matériel lourd ni de compétences pointues en apprentissage automatique en interne. Les équipes commerciales bénéficient ainsi d’un accès immédiat à une technologie de pointe continuellement mise à jour par le fournisseur.

Les risques inhérents liés à la gouvernance des données

Cependant, la médaille de la flexibilité du cloud possède un revers particulièrement préoccupant pour les industriels concernant la gouvernance de l’information. L’utilisation d’interfaces de programmation publiques implique souvent que les données soumises puissent être réutilisées par l’éditeur pour entraîner et perfectionner ses propres modèles futurs, diluant ainsi le secret des affaires. De plus, la localisation physique des serveurs traitant ces informations échappe totalement au contrôle de l’entreprise cliente, soulevant des problématiques épineuses de souveraineté numérique. Le phénomène de dépendance technologique vis-à-vis d’un prestataire unique représente également un risque stratégique majeur à long terme. Pour les entreprises évoluant dans des secteurs d’importance vitale, ces compromis sur la sécurité et le contrôle exclusif de la donnée s’avèrent bien souvent rédhibitoires.

Modèles locaux spécialisés (On-premise) : Maîtrise et sur-mesure

Sécurité absolue et souveraineté de l’information

Pour pallier les failles de sécurité inhérentes au cloud public, de nombreuses organisations industrielles se tournent aujourd’hui vers le déploiement de modèles de langage locaux, souvent issus de l’écosystème open source. Hébergée directement sur les serveurs de l’entreprise ou dans un cloud privé hautement sécurisé, cette architecture garantit une étanchéité totale des données. L’intelligence artificielle fonctionne de manière isolée, empêchant toute exfiltration d’informations stratégiques vers l’extérieur. Cette maîtrise de bout en bout de l’infrastructure matérielle et logicielle permet de respecter scrupuleusement les exigences de conformité les plus draconiennes. La souveraineté de l’information est ainsi préservée, offrant aux dirigeants la garantie absolue que le savoir-faire de l’entreprise reste strictement confiné au sein de son périmètre de sécurité de confiance.

RAG et Fine-tuning : s’adapter au jargon technique spécifique

L’autre atout décisif des modèles déployés en local réside dans leur capacité à être finement personnalisés pour épouser parfaitement le contexte sémantique de l’entreprise. En utilisant des techniques avancées comme la génération augmentée par la recherche, il est possible de connecter le modèle d’intelligence artificielle aux bases de données internes contenant l’historique des appels d’offres remportés et les documentations techniques propres à l’organisation. Un exemple concret illustre parfaitement cette dynamique : un grand fabricant d’équipements industriels a récemment interconnecté son modèle local avec sa propre base de connaissances contractuelles. Cette synergie technologique permet à l’outil de générer des brouillons de réponses non seulement pertinents sur le plan technique, mais adoptant également le ton et le vocabulaire précis de la marque, réduisant ainsi le cycle de rédaction de manière spectaculaire tout en augmentant la pertinence de l’offre finale.

Comment arbitrer et choisir la meilleure architecture pour vos équipes ?

Évaluer le triptyque : Coût, Compétence, Sensibilité des données

La décision finale entre une solution cloud et une architecture locale repose sur une équation complexe intégrant plusieurs variables fondamentales de l’entreprise. Le premier facteur concerne les coûts d’infrastructure, car faire tourner des modèles d’intelligence artificielle en local nécessite d’investir massivement dans des serveurs équipés de processeurs graphiques très onéreux, ainsi que d’attirer des talents rares capables de maintenir ces systèmes complexes. À l’inverse, le cloud facture à l’usage mais peut s’avérer coûteux à long terme. Toutefois, comme le soulignent souvent les experts en architecture de données chez Converteo, le choix d’un modèle d’intelligence artificielle ne doit jamais précéder l’évaluation stricte de la sensibilité de vos données ; c’est véritablement la gouvernance qui doit dicter l’infrastructure technique, et non l’inverse. L’audit préalable des flux d’informations est donc l’étape fondatrice de tout projet de ce type.

Vers une approche hybride pour maximiser la performance commerciale

Dans la pratique, la frontière entre ces deux mondes technologiques tend à s’estomper au profit de stratégies hybrides particulièrement ingénieuses et performantes. Les entreprises industrielles les plus matures déploient désormais des architectures combinant le meilleur des deux approches selon la nature du document analysé. Elles exploitent la vélocité et la puissance de synthèse des modèles cloud pour effectuer un premier tri rapide sur les appels d’offres publics peu sensibles, permettant d’identifier quasi instantanément les opportunités pertinentes. Parallèlement, elles réservent l’usage de leurs modèles locaux hautement sécurisés et spécialisés pour le décryptage approfondi des cahiers des charges critiques et la rédaction des clauses contenant des informations stratégiques. [Intention visuelle : un tableau comparatif mettant en exergue la complémentarité entre l’approche cloud pour l’exploration et l’approche locale pour l’exploitation sécurisée s’insérerait parfaitement ici pour guider la prise de décision]. Cette dualité permet d’optimiser les coûts tout en blindant la sécurité intellectuelle.

L’analyse automatisée des appels d’offres n’est plus une simple expérimentation technologique, mais un véritable impératif de compétitivité pour les acteurs industriels cherchant à rationaliser leurs processus de vente complexes. Que l’on opte pour la puissance immédiatement disponible du cloud public ou pour la forteresse numérique offerte par les modèles locaux, l’intelligence artificielle générative redéfinit fondamentalement la manière dont les entreprises qualifient et remportent de nouveaux marchés. La clé du succès réside dans l’alignement parfait entre l’outil choisi, la sensibilité des informations traitées et les capacités d’investissement de l’organisation.

Pour transformer cette opportunité technologique en un avantage concurrentiel durable, il est indispensable de se faire accompagner par des spécialistes capables d’aligner l’innovation avec vos enjeux d’affaires. Les experts en data architecture et en intelligence artificielle de Converteo se tiennent à votre entière disposition pour auditer vos processus actuels, évaluer précisément vos contraintes de sécurité et vous accompagner de bout en bout dans le déploiement de l’infrastructure la plus performante. N’hésitez pas à nous contacter pour construire ensemble la solution sur mesure qui fera décoller votre taux de conversion.