Modèles prédictifs en Assurance : Faut-il utiliser un LLM ou un Small Model ?

L’irruption des Large Language Models (LLM) dans le secteur de l’assurance bouscule un bastion historique de la science des données : l’actuariat prédictif. Pendant des décennies, la modélisation du risque s’est appuyée sur des algorithmes de Machine Learning classiques, particulièrement performants sur les données tabulaires. Aujourd’hui, la question du choix technologique ne se résume plus à une simple course à la puissance de calcul, mais à un arbitrage stratégique entre la polyvalence cognitive des modèles géants et l’efficience chirurgicale des Small Models. Pour les assureurs, l’enjeu est de déterminer quelle architecture offre le meilleur compromis entre précision prédictive, coût d’inférence et explicabilité, dans un contexte réglementaire où chaque décision automatisée doit pouvoir être justifiée.

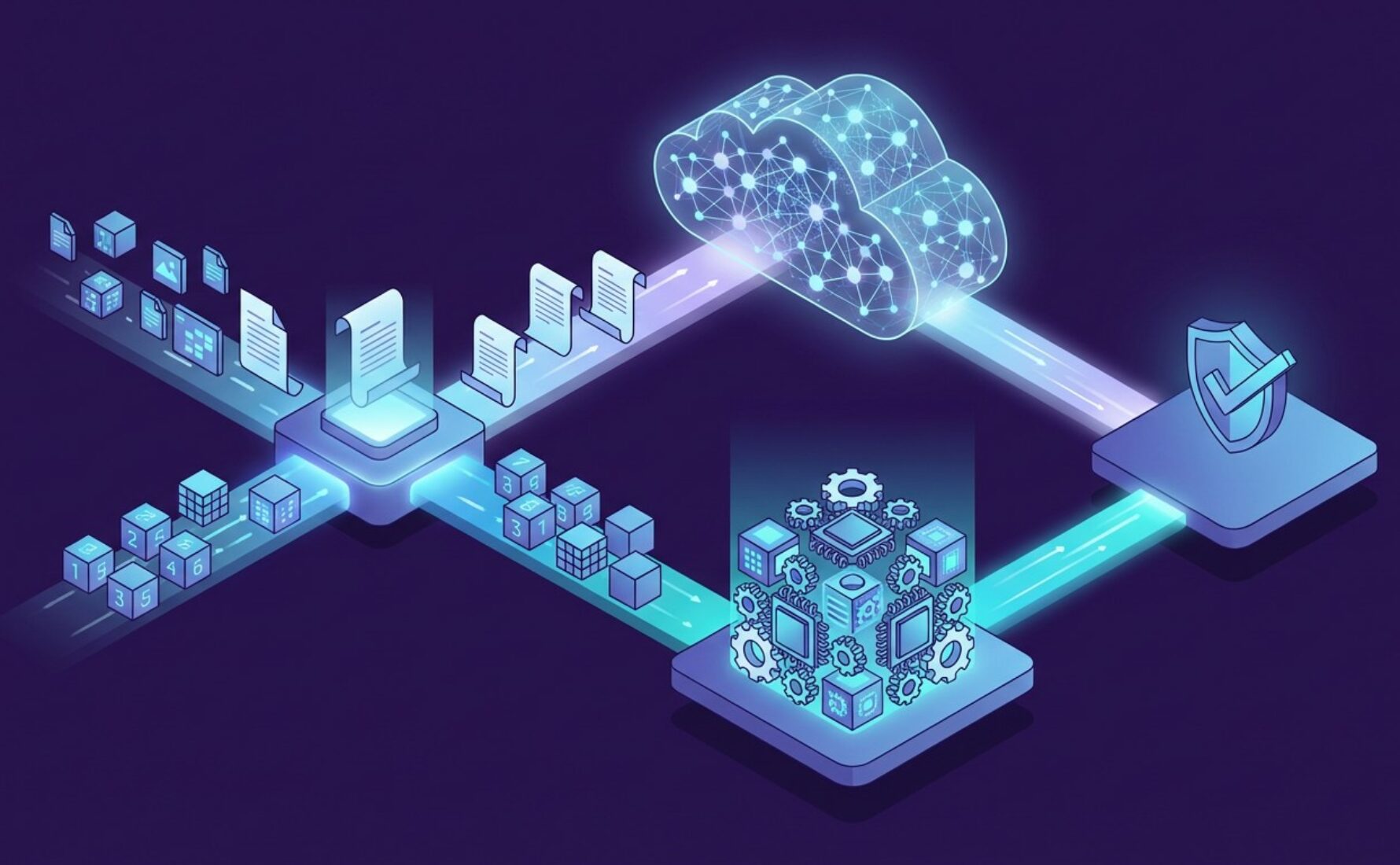

Le déploiement d’agents IA en assurance impose une réflexion sur la complémentarité de ces modèles plutôt que sur leur opposition. Le passage d’une IA purement consultative à une IA agentique, capable de déclencher des virements ou de modifier des contrats, nécessite une orchestration fine. Si les LLM excellent dans la compréhension du langage naturel et le traitement de documents non structurés, ils ne sont pas toujours les outils les plus adaptés pour prédire un score de churn ou une fréquence de sinistres à partir de bases de données structurées. Pour le cabinet Converteo, la maturité d’un projet data se mesure à sa capacité à mobiliser la « juste technologie » pour chaque segment du parcours client.

Cette nécessaire segmentation technologique répond également à des impératifs de performance opérationnelle et de souveraineté. L’arbitrage entre LLM et Small Model devient ainsi une composante essentielle de la stratégie IT, influençant directement la scalabilité des cas d’usage et la rentabilité des investissements IA. Alors que les LLM requièrent des infrastructures cloud massives et coûteuses, les Small Models peuvent souvent être déployés « on-premise » ou sur des environnements plus légers, garantissant une latence minimale et une maîtrise totale des flux de données. Dans un secteur où la protection des données de santé et de prévoyance est sacrée, la possibilité de faire tourner des modèles spécialisés dans un environnement sécurisé est un argument de poids.

En adoptant une vision hybride, les assureurs peuvent enfin réconcilier l’agilité de l’IA conversationnelle avec la rigueur de l’actuariat. L’IA agentique joue ici le rôle de chef d’orchestre, utilisant un LLM pour extraire des informations d’un constat amiable ou d’un rapport médical, puis passant le relais à un Small Model pour calculer l’indemnisation ou le niveau de risque. Nous allons explorer comment structurer cette cohabitation technologique pour transformer votre patrimoine data en un véritable moteur de croissance. L’objectif est de passer d’une IA expérimentale à une IA industrielle, capable de générer une valeur métier concrète tout en respectant les contraintes de coût et de conformité propres au marché de l’assurance.

Données tabulaires vs Données non structurées : Le premier critère de choix

Le choix entre un LLM et un Small Model commence par la nature même de la donnée à traiter. Pour les données tabulaires, qui constituent le socle de l’assurance (âge, historique, type de contrat, bonus-malus), les Small Models comme XGBoost, LightGBM ou les forêts aléatoires conservent une longueur d’avance. Ces modèles sont spécifiquement conçus pour trouver des corrélations mathématiques au sein de colonnes de chiffres et de catégories. Ils offrent une précision supérieure sur ces formats tout en étant extrêmement économes en ressources. À l’inverse, utiliser un LLM pour analyser un fichier Excel de 50 colonnes revient souvent à utiliser un marteau-piqueur pour enfoncer une pointe : c’est possible, mais inefficace et coûteux.

C’est sur le terrain des données non structurées que les LLM révèlent leur supériorité incontestée. L’apport de l’IA générative dans ce processus est crucial pour traiter les données non structurées emprisonnées dans des textes : rapports d’experts, clauses de contrats, transcriptions d’appels ou mails de réclamation. Là où un modèle classique échoue à comprendre le contexte et les nuances, le LLM excelle. Il est capable d’identifier une intention, de résumer un sinistre complexe ou d’extraire des entités nommées avec une précision quasi humaine. Pour un assureur, la question n’est donc pas « quel est le meilleur modèle ? », mais « quelle est la forme de ma donnée ? ».

Performance technique et opérationnelle : Le match

La latence est un facteur de différenciation critique dans les parcours de souscription en ligne. Un Small Model spécialisé peut fournir un score de risque en quelques millisecondes, permettant un affichage instantané du tarif pour l’assuré. En comparaison, les LLM, même optimisés, affichent des temps de réponse nettement plus longs dus à la complexité de leur architecture « transformer ». Pour des applications de pricing dynamique ou de détection de fraude en temps réel lors d’une transaction, la rapidité d’exécution des Small Models reste un avantage concurrentiel majeur. L’immédiateté perçue par le client final dépend directement de cette frugalité algorithmique.

Cependant, les capacités de raisonnement des LLM apportent une profondeur nouvelle à l’analyse prédictive. Un LLM ne se contente pas de classer un dossier, il peut justifier son choix en langage naturel, facilitant ainsi le travail du gestionnaire. Cette capacité d’explicabilité « native » est un atout précieux pour répondre aux exigences de transparence des régulateurs comme l’ACPR. Là où un modèle « boîte noire » classique nécessite des outils tiers pour expliquer ses décisions, le LLM peut pointer précisément les éléments d’un document qui ont motivé son analyse. Cette intelligence contextuelle permet de traiter des cas limites où les règles statistiques pures atteignent leurs limites.

L’équation économique et souveraine : FinOps et Privacy

L’aspect financier est souvent le juge de paix lors du passage à l’échelle. Les coûts d’inférence des LLM, facturés au token, peuvent rapidement devenir prohibitifs pour des flux de masse comme le tri quotidien des emails ou la validation de millions de devis. À l’inverse, un Small Model, une fois entraîné, coûte très peu à opérer et peut être hébergé sur des serveurs standards sans nécessiter de fermes de GPU ultra-puissantes. Pour un assureur attentif à son ratio combiné, l’optimisation FinOps passe souvent par le remplacement d’un appel à un LLM coûteux par un modèle plus petit et spécialisé dès que la tâche le permet.

La souveraineté des données renforce cet arbitrage. Les Small Models sont les candidats idéaux pour un déploiement « on-premise », garantissant que les données sensibles des assurés ne quittent jamais le périmètre sécurisé de l’entreprise. Bien que des solutions de LLM privés émergent, leur mise en œuvre reste complexe et onéreuse. En privilégiant les Small Models pour les calculs de scores de risques individuels, les assureurs simplifient leur mise en conformité RGPD et renforcent la confiance de leurs clients. La sécurité devient alors un sous-produit naturel d’une architecture technologique bien pensée et souveraine.

Vers une architecture hybride : Le meilleur des deux mondes

L’avenir de l’assurance réside dans l’IA hybride, où l’IA agentique sert de pont entre les différentes technologies. Dans cette configuration, un LLM est utilisé en « front-end » pour interagir avec l’utilisateur, comprendre ses besoins et extraire les données pertinentes de ses documents. Ces données sont ensuite transmises à des Small Models spécialisés en « back-end » pour effectuer les calculs de tarification, de scoring de fraude ou de probabilité de churn. Cette approche permet de bénéficier de la fluidité de l’interface conversationnelle tout en conservant la rigueur et la vitesse de calcul des algorithmes classiques.

Cette architecture modulaire offre une flexibilité totale. Elle nécessite de moderniser les SI nécessaires pour supporter des architectures IA plus efficientes et modulaires. En combinant la polyvalence des LLM avec l’efficacité des Small Models, les assureurs ne font plus de compromis : ils construisent une IA robuste, explicable et économiquement viable. C’est cette alliance entre l’innovation générative et l’expertise prédictive qui définit l’assurance de demain, plus proche de ses clients et plus précise que jamais. Converteo vous accompagne dans cette hybridation pour maximiser la valeur de chaque brique de votre écosystème data.