Traitement des données consommateurs FMCG : IA Agentique et conformité RGPD

L’accélération technologique que connaît actuellement le secteur des biens de grande consommation redéfinit en profondeur les stratégies d’engagement client. Face à une volumétrie d’informations qui explose de manière exponentielle, les marques historiques cherchent de nouveaux leviers pour maintenir leur compétitivité et capter l’attention de leurs audiences. La simple collecte ne suffit plus ; c’est désormais la capacité à interpréter et à activer ces signaux faibles en temps réel qui sépare les leaders des suiveurs. Dans ce contexte d’hyper-compétition, l’intelligence artificielle s’impose non pas comme une option expérimentale, mais comme le moteur central de la transformation numérique des entreprises du secteur.

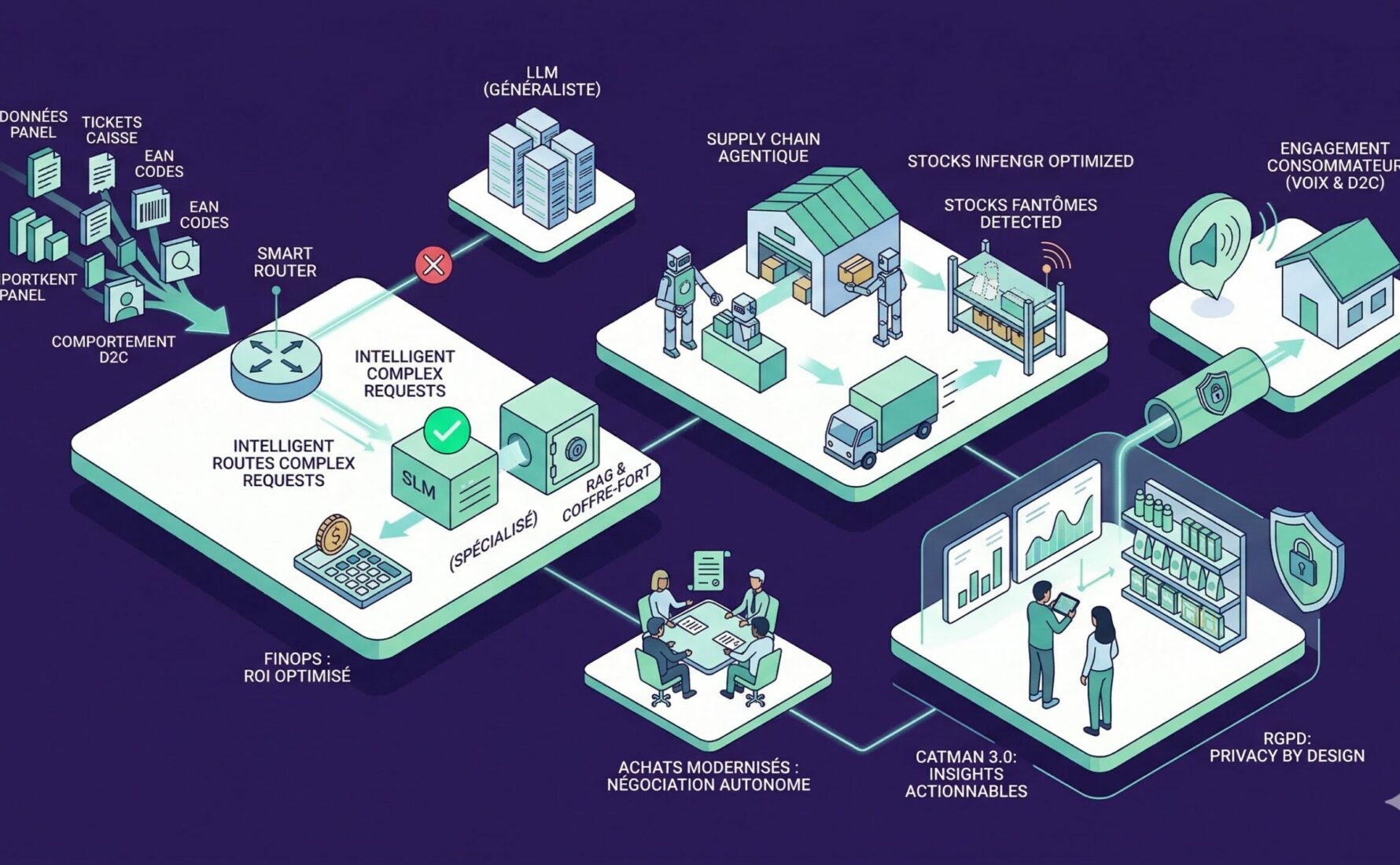

Au cœur de cette révolution opérationnelle se trouve l’intelligence artificielle agentique, une évolution majeure qui dépasse largement les au-delà des capacités de l’intelligence artificielle générative classique. Contrairement aux modèles traditionnels qui se contentent de répondre à des requêtes ponctuelles et d’assister les collaborateurs, les agents autonomes sont capables d’analyser un contexte, de formuler un plan d’action stratégique et d’exécuter des tâches complexes de manière totalement indépendante. Pour les acteurs du FMCG, cela représente une opportunité inédite de traiter les parcours d’achat avec une précision chirurgicale, en anticipant les besoins avant même qu’ils ne soient explicitement formulés par les acheteurs lors de leurs passages en caisse ou en ligne.

Cependant, cette puissance d’analyse prédictive et cette autonomie décisionnelle inédite soulèvent inévitablement des interrogations majeures quant à la protection de la vie privée et à la sécurité. La réglementation européenne, à travers le RGPD, impose un cadre juridique strict visant à garantir que chaque innovation technologique respecte les droits fondamentaux des individus face à la collecte de masse. La problématique n’est donc plus simplement d’ordre technique ou de performance, mais devient profondément stratégique et légale pour les directions marketing, les architectes data et les responsables de la conformité au sein des grands groupes.

Comment, dès lors, les grandes entreprises peuvent-elles concilier le formidable potentiel d’automatisation des agents autonomes avec les exigences intransigeantes de la conformité réglementaire ? Le défi consiste à bâtir des architectures de données suffisamment agiles pour nourrir ces algorithmes sophistiqués avec une fraîcheur irréprochable, tout en intégrant des garde-fous robustes dès la conception initiale des plateformes. Cet équilibre délicat entre une innovation poussée à son paroxysme et une gouvernance éthique irréprochable constitue le nouveau paradigme que les marques de grande consommation doivent impérativement maîtriser pour pérenniser leur relation de confiance avec le public.

L’émergence de l’IA Agentique dans le secteur de la grande consommation

De l’IA générative aux agents autonomes : une rupture technologique

La transition de l’intelligence artificielle générative vers les systèmes agentiques marque un tournant décisif dans la manière dont les entreprises appréhendent l’automatisation de leurs processus métiers. Jusqu’à présent, les modèles de langage excellaient dans la création de contenus marketing ou la synthèse d’informations disparates, mais ils restaient fondamentalement réactifs et limités à la fenêtre de contexte fournie par l’utilisateur humain. L’intelligence artificielle agentique, en revanche, introduit la notion d’autonomie complète et de raisonnement itératif au sein des écosystèmes technologiques. Ces agents avancés sont programmés pour poursuivre des objectifs d’affaires spécifiques, interagir de leur propre chef avec diverses bases de données de l’entreprise et prendre des initiatives pour résoudre des problèmes complexes sans intervention extérieure. Dans l’univers de la grande consommation, cette rupture technologique signifie qu’un système peut désormais surveiller de manière proactive les tendances émergentes sur les réseaux sociaux, croiser ces signaux sociétaux avec les historiques d’achats internes et déclencher de manière autonome une campagne promotionnelle ultra-ciblée. Cette capacité inouïe à orchestrer des flux de travail de bout en bout démultiplie la force de frappe des équipes d’analystes tout en réduisant drastiquement le temps de mise sur le marché des nouvelles offres commerciales.

Optimisation de l’engagement client et personnalisation en temps réel

L’application concrète des agents autonomes dans le commerce de détail et le FMCG transforme radicalement l’expérience proposée aux acheteurs finaux tout au long de leur cycle de vie. En analysant en continu des milliers de variables comportementales, géographiques et transactionnelles, ces systèmes intelligents parviennent à créer des recommandations produits d’une pertinence absolue au moment le plus opportun. Par exemple, un agent prédictif peut détecter qu’un foyer modifie subtilement ses habitudes de consommation vers des produits plus diététiques, ajuster instantanément les communications numériques qui lui sont adressées sur tous les canaux et proposer des remises exclusives sur des lancements de gammes biologiques. Les observations du marché montrent d’ailleurs que les entreprises qui déploient une telle personnalisation à grande échelle augmentent significativement leurs taux de conversion tout en optimisant considérablement leurs dépenses publicitaires globales. L’automatisation intelligente de ces analyses complexes permet de maintenir un dialogue constant et ultra-personnalisé avec chaque individu, créant ainsi une relation de proximité totalement inédite pour des marques qui opéraient traditionnellement via des réseaux de distribution de masse souvent opaques. La fidélisation n’est dès lors plus basée sur des segments génériques artificiels, mais sur une compréhension intime, granulaire et dynamique des préférences individuelles de chaque client.

Le défi de la conformité RGPD à l’heure de l’automatisation souveraine

Les risques spécifiques liés à l’autonomie décisionnelle des agents

Le déploiement de l’intelligence artificielle agentique au cœur des systèmes d’information introduit une complexité inédite dans l’évaluation des risques liés au traitement des informations personnelles des consommateurs. L’autonomie inhérente à ces nouveaux systèmes signifie qu’ils peuvent prendre des dizaines de milliers de micro-décisions de ciblage ou de profilage de manière dynamique et instantanée, rendant parfois très difficile la traçabilité exacte des critères ayant mené à une recommandation précise. Le Règlement Général sur la Protection des Données exige pourtant une transparence totale des algorithmes et offre aux citoyens le droit formel de ne pas faire l’objet d’une décision fondée exclusivement sur un traitement automatisé ayant des effets juridiques ou les affectant de manière significative. Les directions juridiques et les délégués à la protection des données font donc face à un défi de gouvernance d’une ampleur sans précédent : auditer et documenter des algorithmes qui évoluent de manière autonome et adaptent leurs propres logiques décisionnelles en continu. Il est absolument crucial de s’assurer que ces agents ne génèrent pas de biais discriminatoires involontaires lors de la segmentation fine des audiences et qu’ils respectent toujours de manière très stricte les finalités initiales pour lesquelles le consentement a été légalement recueilli. L’absence d’une supervision algorithmique adéquate pourrait non seulement entraîner des sanctions financières colossales de la part des régulateurs, mais également détruire de façon irrémédiable la confiance patiemment construite auprès du grand public.

Intégrer le Privacy by Design dans le déploiement des systèmes agentiques

Pour pallier ces risques structurels évidents, le principe fondamental du Privacy by Design doit impérativement devenir la pierre angulaire et le prérequis de tout projet technologique impliquant des agents autonomes. Cette approche proactive impose aux équipes d’ingénierie de prendre en compte la protection absolue de la vie privée dès la phase initiale de conception de l’architecture et non plus comme une simple formalité ajoutée a posteriori lors de la mise en production. Concrement, cela implique de paramétrer rigoureusement les modèles d’intelligence artificielle pour qu’ils fonctionnent par défaut avec la quantité la plus minimale possible d’informations personnelles requise pour accomplir correctement leur tâche d’analyse. Les architectes de ces solutions complexes doivent obligatoirement intégrer des mécanismes de contrôle humain tangibles dans la boucle d’exécution, permettant aux experts métiers de valider ou de bloquer les décisions stratégiques critiques proposées par l’agent avant leur exécution finale auprès du client. Comme le soulignent d’ailleurs unanimement les experts en droit du numérique, la responsabilité ultime et finale des actions entreprises par un système, aussi autonome soit-il, incombe toujours pleinement à l’entreprise qui fait le choix de le déployer. Il est donc totalement indispensable de mettre en place des registres d’audit hautement automatisés qui documentent et horodatent chaque étape du cheminement logique de l’agent. Cette transparence technologique assumée, couplée à une ingénierie extrêmement rigoureuse des processus de récolte du consentement, garantit que l’innovation technologique serve la performance commerciale sans jamais avoir à sacrifier le respect le plus strict des droits fondamentaux des consommateurs.

Stratégies pour un traitement de données éthique et performant

La gouvernance des données comme socle indispensable à l’intelligence artificielle

L’efficacité réelle et la fiabilité d’un agent autonome déployé à grande échelle dépendent de manière intrinsèque de la qualité, de la profondeur et de la structuration des informations qu’il est amené à consommer quotidiennement. Une gouvernance informationnelle extrêmement rigoureuse s’impose par conséquent comme le prérequis absolu à toute initiative d’intelligence artificielle aboutie dans le secteur très concurrentiel de la grande consommation. Les entreprises doivent être capables de cartographier avec une précision chirurgicale l’ensemble de leurs bases existantes, depuis les systèmes historiques de gestion de la relation client jusqu’aux plateformes e-commerce les plus récentes, en passant bien sûr par les immenses volumes de données issus des programmes de fidélité. Cette cartographie exhaustive permet d’identifier efficacement les silos organisationnels, d’harmoniser les formats hétérogènes et de s’assurer de la fraîcheur constante des informations injectées dans les modèles. Une gouvernance robuste implique également de définir des rôles très clairs concernant la propriété métier et les droits d’accès aux différents jeux d’informations au sein de l’organisation globale. En instaurant un référentiel unique, centralisé et parfaitement fiable, les marques s’assurent que leurs algorithmes avancés ne seront pas biaisés par des historiques d’achats obsolètes ou par des doublons clients non résolus. C’est uniquement cette fondation architecturale totalement assainie qui permet aux agents virtuels de naviguer dans le vaste patrimoine informationnel de l’entreprise avec une fluidité optimale, tout en appliquant de manière systémique et cohérente les politiques de sécurité définies par les équipes juridiques.

L’anonymisation et la sécurisation des flux d’informations consommateurs

Au-delà de la nécessaire structuration interne, la protection technique active des flux d’informations constitue indéniablement le second pilier d’un traitement à la fois éthique et hautement performant. L’utilisation généralisée de techniques avancées d’anonymisation et de pseudonymisation est strictement indispensable pour dissocier définitivement l’identité directe des individus de l’analyse de leurs comportements d’achat au quotidien. Les agents autonomes peuvent ainsi repérer efficacement des tendances macro-économiques globales ou optimiser finement des algorithmes complexes de recommandation sans jamais risquer de compromettre l’intimité d’une personne physique spécifiquement identifiable. Le recours grandissant à des données purement synthétiques, générées de manière totalement artificielle par des algorithmes mais conservant scrupuleusement les propriétés statistiques des cohortes réelles, représente d’ailleurs une voie extrêmement prometteuse pour entraîner les nouveaux modèles en garantissant une sécurité absolue. Parallèlement à ces méthodes, le chiffrement de bout en bout des communications entre les différents modules logiciels de l’intelligence artificielle garantit la stricte confidentialité des informations lors des multiples transferts vers les infrastructures cloud. La mise en place d’une politique de sécurité drastique de type Zero Trust, où chaque requête interne est systématiquement authentifiée, autorisée et vérifiée en temps réel, empêche toute fuite malveillante ou accidentelle lors du traitement de ces volumes à grande échelle. Cette approche de sécurité globale en profondeur rassure efficacement l’ensemble des partenaires commerciaux et consolide durablement la réputation de la marque sur un marché devenu extrêmement sensible et vigilant quant aux grands enjeux de confidentialité numérique.

Les questions clés sur l’IA Agentique et le cadre réglementaire

L’intégration rapide de ces nouvelles technologies autonomes soulèvent naturellement de très nombreuses interrogations légitimes et pratiques au sein des directions marketing et digitales. Une préoccupation particulièrement fréquente sur le marché concerne la mise en place de plateformes de gestion du consentement hautement dynamiques, qui sont techniquement capables de réinterroger subtilement les clients lors de leur navigation ou lors du lancement de nouvelles fonctionnalités prédictives importantes. Une autre préoccupation majeure des responsables conformité touche à l’exercice du droit à l’oubli et à sa grande complexité d’application technique face à des modèles de langage qui ont déjà ingéré et assimilé les informations lors de leurs phases d’entraînement initiales. Les entreprises doivent absolument s’assurer dès la conception que leurs architectures de bases de données permettent d’isoler, de retrouver et de supprimer très efficacement tout l’historique d’un individu précis sans pour autant venir perturber ou corrompre l’apprentissage global du reste du système intelligent. Enfin, beaucoup de professionnels s’interrogent légitimement sur la durée de conservation la plus pertinente pour les vastes historiques comportementaux accumulés. Les meilleures pratiques du secteur recommandent vivement de purger de manière très régulière les signaux faibles devenus obsolètes dans le temps, ce qui présente le double avantage décisif de respecter scrupuleusement les principes de minimisation du RGPD tout en augmentant paradoxalement la pertinence, la vélocité et la précision des analyses algorithmiques actuelles en supprimant le bruit statistique.

Conclusion

La convergence inévitable entre l’essor fulgurant de l’intelligence artificielle agentique et les impératifs non négociables de conformité réglementaire est en train de redessiner durablement le paysage technologique et stratégique de la grande consommation. Les marques visionnaires qui sauront tirer pleinement parti de ces systèmes autonomes avancés pour hyper-personnaliser leurs offres, tout en érigeant simultanément la protection rigoureuse de la vie privée en un véritable avantage concurrentiel différenciant, prendront assurément une avance décisive sur leurs marchés respectifs. Le véritable défi de cette décennie n’est pas de chercher à entraver l’innovation par la contrainte de la régulation, mais bien au contraire de concevoir des architectures résilientes où l’éthique devient la boussole qui guide la performance technologique globale. Pour réussir à transformer cette grande complexité technique et juridique en une formidable opportunité de croissance tangible et durable, une évaluation approfondie et objective de vos infrastructures data actuelles constitue la toute première étape incontournable. Nous vous invitons dès à présent à solliciter nos experts pour un audit complet de votre maturité sur ces sujets cruciaux, afin de bâtir ensemble une stratégie pérenne qui allie la puissance algorithmique de demain à la confiance absolue de vos consommateurs.