Déploiement sur site (On-Premise) vs Cloud : Le choix des modèles IA en Banque

Table des matières

- Les enjeux de la souveraineté et de la sécurité des données financières

- Le modèle On-Premise : Le sanctuaire de la maîtrise technologique

- Le Cloud : Catalyseur d’innovation et de scalabilité pour l’IA

- Vers une approche hybride : Le compromis stratégique

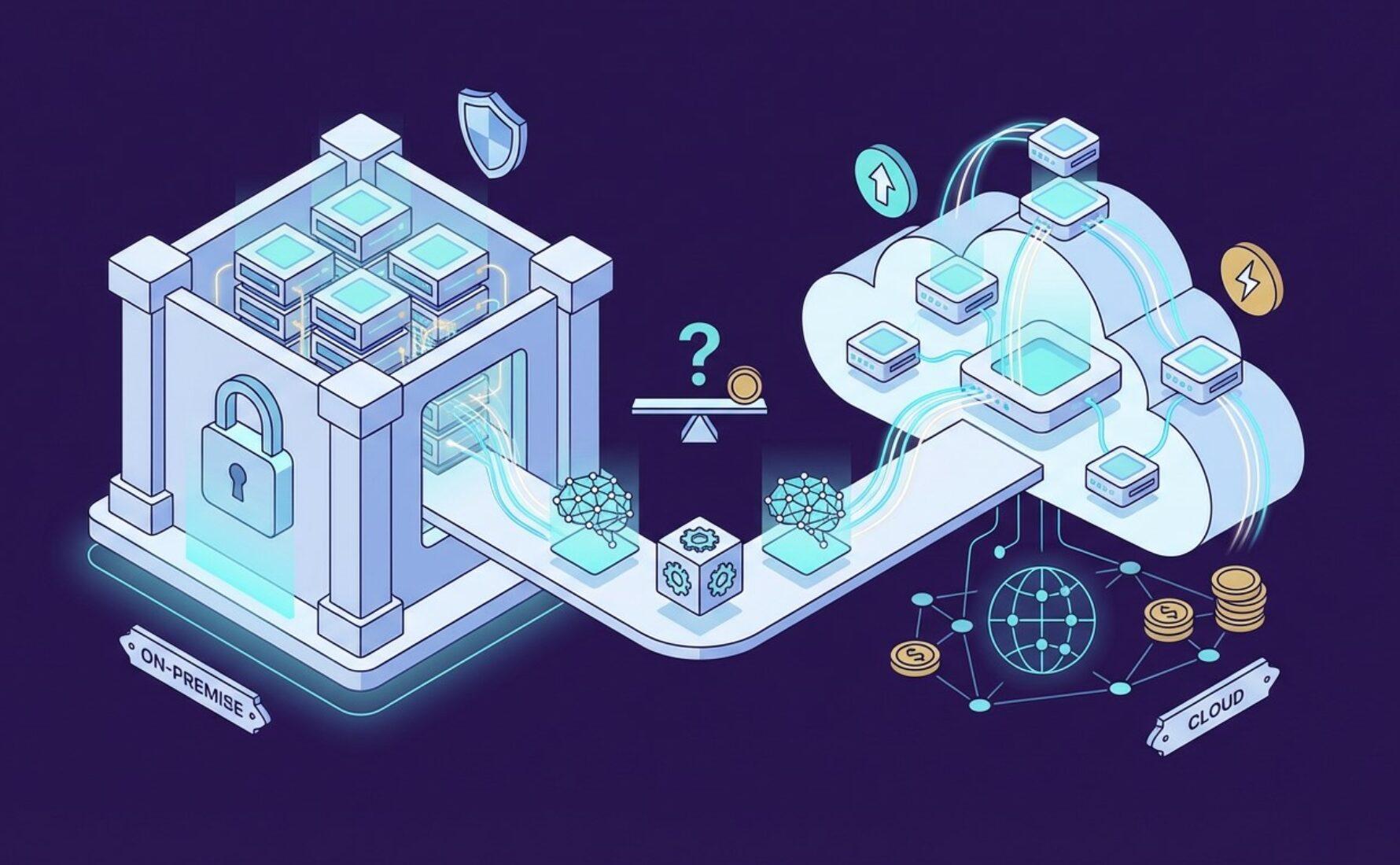

L’accélération fulgurante de l’intelligence artificielle générative place les institutions financières devant un dilemme infrastructurel sans précédent. Pour les directions des systèmes d’information et les chief data officers, l’arbitrage entre le déploiement sur site et les solutions cloud ne relève plus seulement d’une question de budget, mais d’une vision stratégique à long terme. La banque, secteur historiquement conservateur en raison de contraintes réglementaires lourdes, doit aujourd’hui concilier l’agilité nécessaire à l’innovation IA avec une protection absolue des actifs informationnels.

Le choix d’une architecture technologique pour porter des modèles de langage ou des algorithmes de scoring prédictif impacte directement la capacité d’une banque à rester compétitive face aux néo-banques et aux fintechs. Si le cloud offre une promesse de scalabilité infinie et un accès immédiat aux modèles les plus performants du marché, l’infrastructure sur site reste le bastion de la souveraineté. Ce débat technique cache en réalité une interrogation profonde sur la propriété intellectuelle des modèles et la maîtrise des flux de données sensibles.

Dans ce contexte, les décideurs bancaires sont confrontés à une pression constante pour réduire les délais de mise sur le marché tout en garantissant une résilience opérationnelle totale. L’intelligence artificielle, particulièrement dans ses formes les plus gourmandes en ressources comme les grands modèles de langage, redéfinit les frontières de ce que l’informatique bancaire peut absorber en interne. Il ne s’agit plus de stocker des données, mais d’orchestrer une puissance de calcul massive capable de transformer des pétaoctets de transactions en insights actionnables en temps réel.

Cet article explore les dimensions critiques de cet arbitrage stratégique en analysant les forces et les faiblesses des deux approches pour le secteur financier. À travers l’examen de la sécurité, des coûts opérationnels et de la performance technologique, nous définirons comment les banques peuvent structurer leur roadmap IA. L’objectif est de fournir une grille de lecture claire pour naviguer entre les exigences de conformité et l’impératif d’innovation qui caractérise l’ère de l’intelligence artificielle appliquée à la finance.

Les enjeux de la souveraineté et de la sécurité des données financières

La gestion des données hautement sensibles, ou données à caractère personnel identifiables, constitue le premier rempart de l’activité bancaire. Dans un environnement où la moindre fuite de données peut entraîner des sanctions financières colossales et une perte de confiance irrémédiable, la sécurité n’est pas une option mais le fondement même de l’architecture. Le secret bancaire impose une étanchéité stricte des flux d’informations, ce qui rend l’intégration de modèles d’IA tiers particulièrement complexe. L’utilisation de modèles hébergés par des fournisseurs externes nécessite des protocoles de chiffrement de bout en bout et une anonymisation rigoureuse avant tout traitement, augmentant mécaniquement la complexité des pipelines de données.

Le cadre réglementaire actuel renforce cette nécessité de contrôle avec des exigences de plus en plus précises de la part d’organismes comme l’Autorité de contrôle prudentiel et de résolution. La conformité au Règlement général sur la protection des données s’ajoute aux directives européennes sur l’IA, imposant une auditabilité totale des décisions prises par les algorithmes. Pour une banque, être capable d’expliquer pourquoi un crédit a été refusé par une IA est une obligation légale qui nécessite une maîtrise complète de la chaîne de traitement. Le coût moyen d’une violation de données dans le secteur financier s’élève désormais à plusieurs millions d’euros, ce qui justifie une approche prudente dans l’exposition des données aux infrastructures tierces.

Le modèle On-Premise : Le sanctuaire de la maîtrise technologique

Le déploiement sur site offre l’avantage majeur d’un contrôle total sur l’intégralité de la stack technologique, du serveur physique jusqu’à l’application finale. Pour une institution financière, cette isolation réseau est la garantie ultime contre les vulnérabilités liées au cloud public. En conservant les modèles d’IA au sein de ses propres datacenters, la banque s’assure que ses données ne quittent jamais son périmètre de sécurité, éliminant ainsi les risques liés au transfert transfrontalier ou à l’accès par des tiers. C’est le choix privilégié pour les cas d’usage critiques comme le scoring de crédit hautement sensible ou la détection de fraude interne, où la confidentialité des règles métiers est un avantage concurrentiel jalousement gardé.

Cependant, cette maîtrise absolue s’accompagne d’une complexité opérationnelle et d’investissements initiaux très élevés, souvent classés en dépenses de capital. L’acquisition de processeurs graphiques performants pour l’entraînement de modèles propriétaires représente un coût massif, sans compter les compétences rares nécessaires pour maintenir et optimiser ces infrastructures spécifiques. Contrairement au cloud, le modèle sur site ne permet pas une adaptation rapide à une montée en charge soudaine, ce qui peut freiner l’expérimentation de nouveaux services. La maintenance hardware devient alors un centre de coût important, nécessitant des cycles de mise à jour fréquents pour ne pas se laisser distancer par l’évolution technologique rapide des composants dédiés à l’intelligence artificielle.

Le Cloud : Catalyseur d’innovation et de scalabilité pour l’IA

À l’opposé, le cloud s’impose comme le moteur de l’innovation grâce à sa capacité de calcul à la demande. Pour l’entraînement de modèles d’IA complexes, le cloud permet d’activer des milliers de processeurs en quelques minutes, offrant une agilité que peu de datacenters internes peuvent égaler. Cette flexibilité transforme les dépenses d’investissement en dépenses opérationnelles, permettant aux banques de tester des hypothèses sans s’engager sur des achats de matériel lourds. L’accès immédiat aux modèles de pointe, tels que les derniers grands modèles de langage via des interfaces de programmation managées, permet de déployer des agents conversationnels ou des outils d’analyse documentaire en un temps record.

L’agilité apportée par les fournisseurs de cloud ne doit toutefois pas masquer le risque de dépendance technologique, souvent appelé verrouillage fournisseur. S’appuyer exclusivement sur les services d’un géant du cloud pour ses capacités d’IA expose la banque à des changements de tarification unilatéraux ou à des évolutions de modèles qui peuvent impacter la performance des applications existantes. Comme le soulignent de nombreux experts en stratégie data, le véritable défi consiste à consommer la puissance du cloud sans y aliéner sa propriété intellectuelle. La scalabilité est un atout indéniable pour gérer les pics d’activité, mais elle demande une gouvernance stricte pour éviter que les coûts de consommation ne dérivent de manière incontrôlée.

Vers une approche hybride : Le compromis stratégique

La maturité technologique conduit aujourd’hui la majority des grands groupes bancaires vers une approche hybride. Cette stratégie consiste à segmenter les cas d’usage en fonction de la criticité des données et de la puissance de calcul requise. Les traitements massifs de données non sensibles ou l’expérimentation rapide se font dans le cloud, tandis que les moteurs de décision stratégiques et les données clients confidentielles restent protégés sur site. Cette architecture permet de bénéficier du meilleur des deux mondes : la rapidité de l’innovation externe et la sécurité du bastion interne. Elle impose néanmoins une orchestration complexe entre les différents environnements pour garantir une fluidité des données.

Une tendance émergente renforce cette vision hybride avec l’apparition des modèles de langage de taille réduite qui peuvent être déployés localement avec des performances surprenantes. Ces modèles permettent de réaliser des tâches spécifiques comme le résumé de documents ou l’extraction d’entités directement sur les serveurs de la banque, réduisant ainsi la latence et les coûts de transfert. Le choix de l’infrastructure devient alors un curseur dynamique que la banque déplace selon ses besoins, ses contraintes réglementaires et son appétit pour le risque. En conclusion, l’arbitrage entre cloud et on-premise n’est plus binaire mais granulaire, exigeant une expertise pointue pour définir la roadmap infrastructurelle la plus cohérente avec les ambitions business de l’institution.